背景介绍

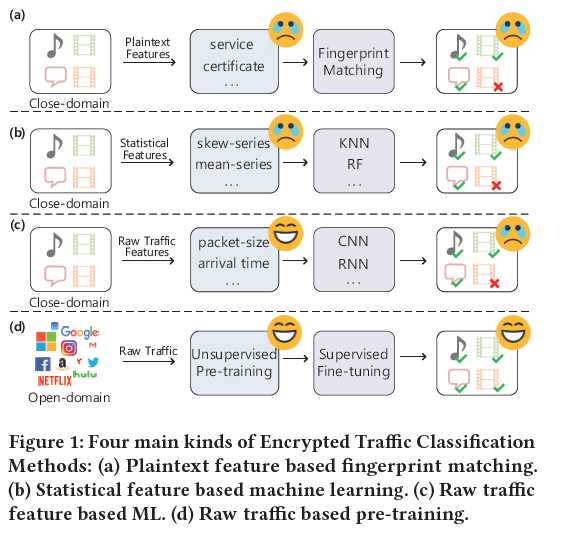

近十年间,伴随网络传输协议加密化的发展,流量分类的研究工作也在不断优化以适应现实场景下的流量分类需求。现有的工作已经意识到流量爆炸式增长和加密化不能再利用专家经验来手动构建明文字段构成的指纹库。

一种基于明文报文包头域信息聚类和交叉关联的方法 FlowPrint 优化了对专家经验的依赖,但仍无法在全密化趋势的新型加密协议 TLS 1.3 中发挥作用。而另外两类典型的方法是依赖专家经验构造流序列统计特征和使用深度模型学习原始流序列的表征,他们优化了模型对明文的依赖性但是需要大量人工成本或准确标注的流序列。由于加密协议的全密化发展趋势和隐私保护相关法律的日益完善,获取准确标注的大规模流量不只是一个困难的工程问题,也面临社会管理和合法合规的挑战。因此,现有典型的三类方法的缺点是明显的。

在自然语言处理和计算机视觉等领域,无监督的大规模预训练模型被提出并在相应领域取得里程碑式的发展。在自然语言处理中,BERT 等工作提出即使没有标注,文字词语和句子之间也有关联关系能够学习并帮助构建这些自然语言的表征,并且对现有待解决的问题具有明显增益。但是如何在加密流量中引入,并且有效地进一步解决现有挑战是本篇文章重点解决的问题。

HongYe He 等人是已知近几年的首次尝试应用预训练架构到加密流量分类任务,但是研究者发现他们的尝试还有很多可优化的地方。网络流量本身是无语义的编码符号序列,但是网络传输过程受到实际内容(例如文本,图片,音频,视频等)的不同以及前后顺序的差异的影响,这导致直接将流序列视作“句子”进行生硬迁移的效果还不理想。

因此,研究者认为:

现有挖掘加密流量特征的模型并没有考虑到加密流量在不同场景下都具有流量的共性特征,在流量表征过程只关注单一场景;

现有引入预训练架构的模型没有从深层次发掘和利用流量的传输行为对区分不同应用的关联关系。

方法介绍

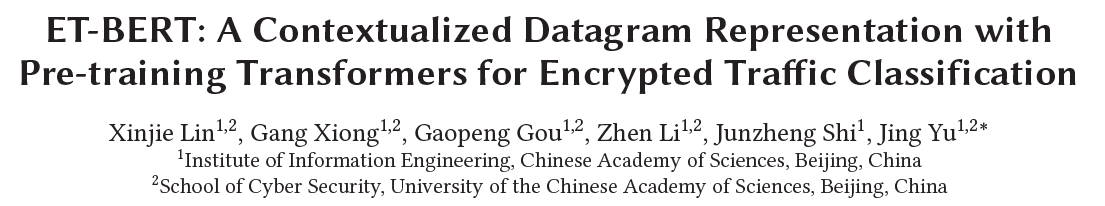

针对这些挑战,研究者提出了一种基于挖掘流量上下文和传输关系的加密流量表征模型— ET-BERT(Encrypted Traffic Bidirectional Encoder Representations from Transformer)。该方法使用掩码 BURST 预测任务(Masked BURST Model)和同源 BURST 预测任务(Same-origin BURST Prediction),来挖掘和表征加密流量报文的隐式关联信息。

研究者表明,ET-BERT 的关键思路在于从原始流量报文中捕获健壮通用的关联关系并且不仅在过去、现在的不同网络流量场景中有效应用,还能适应全加密的未来网络流量场景。

说明:加密流量及其结构

流量的形式在网络传输中是二进制的比特流形式,主要构造单元有数据包和会话流。其中数据包为传输最小完整单元;会话流由通信的设备两端的一个完整交互单元,由多个数据包组成;BURST 结构在本文中定义的是会话流中的局部结构,由会话流中单向传输的连续 n 个数据包组成。

ET-BERT

具体而言,该方法主要分为三个部分:A.预处理和编码加密流量为 token 组成的 BURST 结构,B.预训练学习加密流量报文的关联关系,C.将预训练模型应用到下游任务中微调。

预处理阶段的关键在于将原始的会话流量抽取带有内容传输特性的 BURST 结构和显著偏置的数据信息。BURST 结构是由于不同网络服务的内容在与客户端交互时的内容结构差异产生的带有传输特性的流量结构。相比于直接将完整报文作为模型输入进行表示学习,这种预处理能够更好结合本文使用的预训练任务。

预训练阶段的关键在于利用自监督学习任务从大规模无标注的 BURST 结构化流量报文中捕捉到内容的上下文关系以及流量传输的同源关系。在网络流量中,离散的加密数据包作为基础单元无法体现出不同应用、服务的差异性。为了挖掘流量信息之间的可区分特性,研究者不仅是对符号上下文进行掩码预测学习,同时对 BURST 结构进行截断成对并预测来源于相同 BURST 的 BURST 子对。相比于只学习符号上下文的关系,这两种自监督任务能够兼顾流量的传输关系以及内容关联性,并且更好地为下游场景服务。

微调阶段是对带标注的不同场景的流量数据进行两种通用输入结构的处理,包括包级别和流级别。这两种处理也是应用场景中通常使用的模式,在预训练好模型的基础上继续训练较少的轮次以达到最适合特定场景的识别需求。

实验与分析

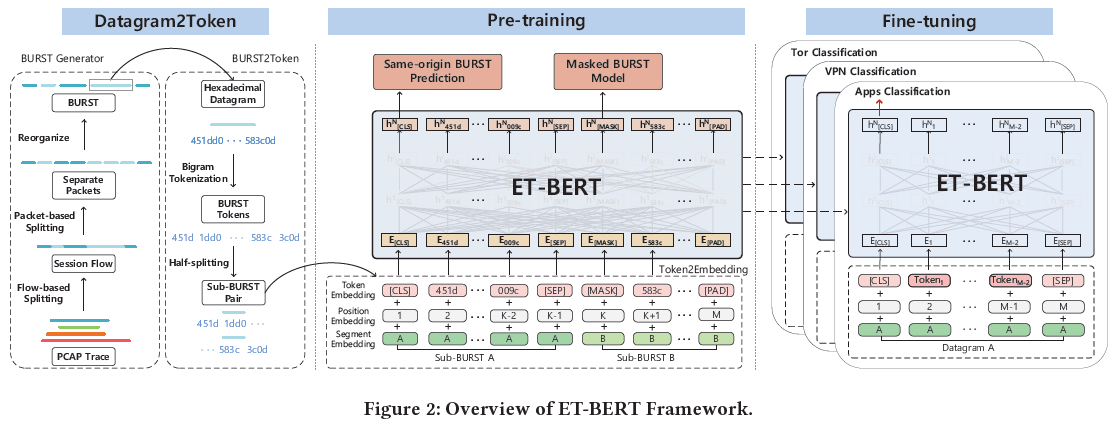

为了证明提出的 ET-BERT 框架的有效性,研究者在网络流量分类公开数据集 ISCX-VPN,ISCX-Tor,USTC-TFC 和 Cross-Platform 数据集以及自采的 CST-NET TLS 1.3 数据集上进行了实验。采用准确性指标 macro-accuracy,精确度指标 macro-precision,召回率指标 macro-recall,以及 F-measure 指标 macro-F1 进行评估。

总体结果

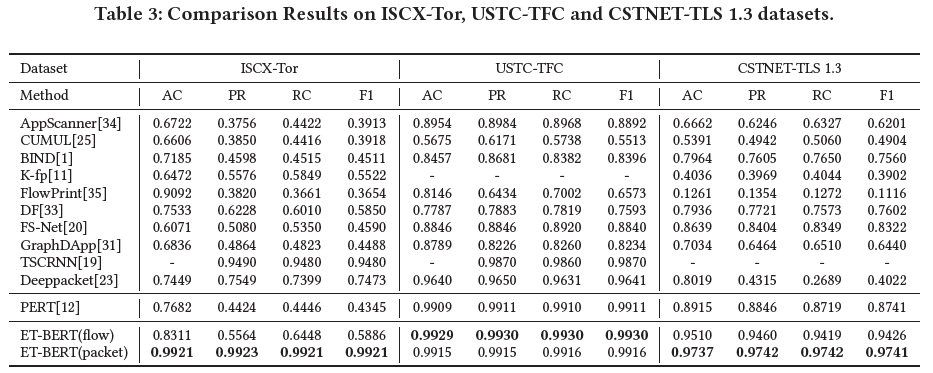

研究者将 ET-BERT 模型和五个场景下的 11 个代表模型在所有场景任务中进行了比较,包括 AppScanner,CUMUL,BIND,K-fp,FlowPrint,DeepFingerprint,FS-Net,GraphDApp,TSCRNN,Deeppacket 和 PERT。表 2 和表 3 中报告了具体的结果。

由结果可以看到,尽管在个别场景的数据集下,FS-Net、Deeppacket 等传统模型是具有强大性能展现的,但在不同场景下的迁移性不足,而 ET-BERT 在所有场景下的性能表现波动明显优于对比模型。此外,该研究在测试集上实现了比其他方法更好的结果,这进一步证明了 ET-BERT 强大的泛化能力。

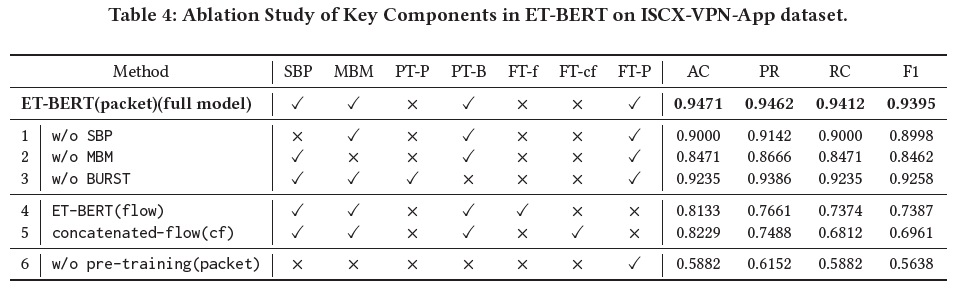

消融实验

研究者对该研究进行消融实验,以了解 ET-BERT 中具有和不具有单个模块与处理模式的影响。如表 4 所示,研究者选择了学术界引用较多的 ISCX-VPN 数据集作为消融实验数据来源。ET-BERT 在没有单一模块的情况下在测试集的性能均有不同程度的下降,这验证了所提出的每个模块对表征加密流量起到了积极作用。

解释性分析

从结果而言,目前为止的数据已经表现了 ET-BERT 的可靠性能,但是研究者对加密流量在无语义的背景前提下为何能够借助自然语言处理领域的 BERT 思想展开了一定的探索和解释,这对进一步提高模型在流量场景应用的泛化能力是十分有益的。

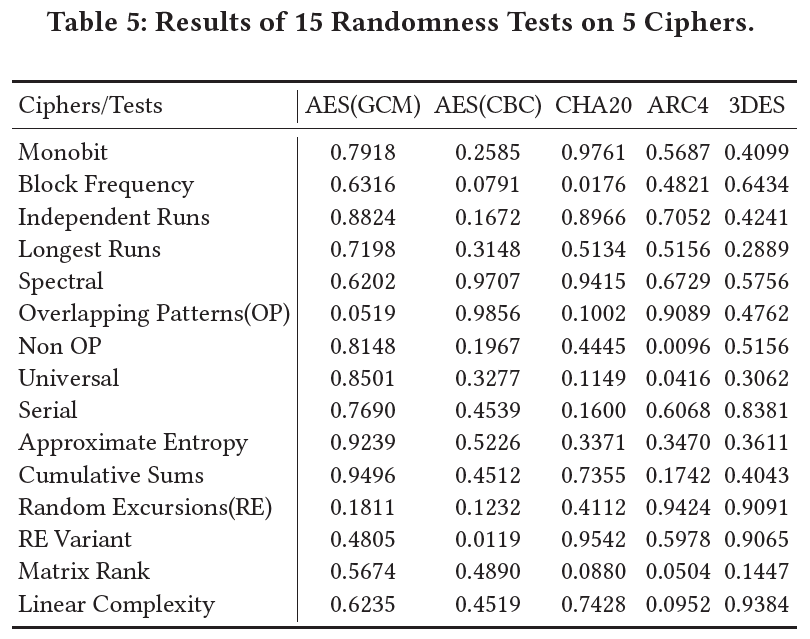

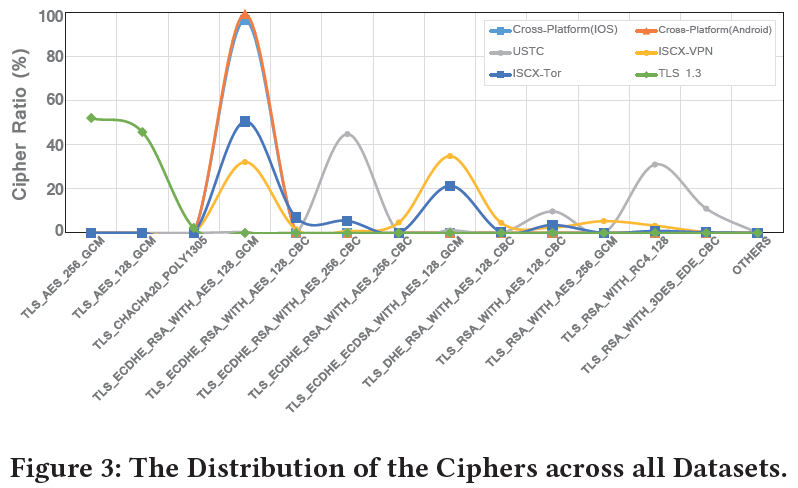

在密码学体系中,理想的安全密码体制包含两个特性:雪崩效应和完备性(扩散和混淆特性),他们能够保证加密数据的真实随机性,而使得攻击者无法从加密数据中获取任何有利于破译信息的模式。然而,在现实密码系统中,完全随机并未被实现,部署在网站、应用中的不同加密算法存在着不一致的随机性。为了衡量现有常见加密算法的安全强度以及实际流量数据中密码套件的分布,研究者对常见的 5 类加密套件进行 NIST 随机性测试评估和密码套件统计。

如表 5 所示,不同密码套件在 15 种随机性测试项目下展现出的随机性指标差异明显,这种随机性差异会放大部署了不同密码套件的加密流量间的区分性。同时,如图 3 所示,研究者发现在 6 种测试场景的数据集中,TLS 1.3 部署了随机性较强的加密套件并且分布维度偏单一化。对比分类性能结果,研究者认为密码套件的实际部署不当可能导致加密流量数据更易被识别。

质量分析

小样本场景分类的质量

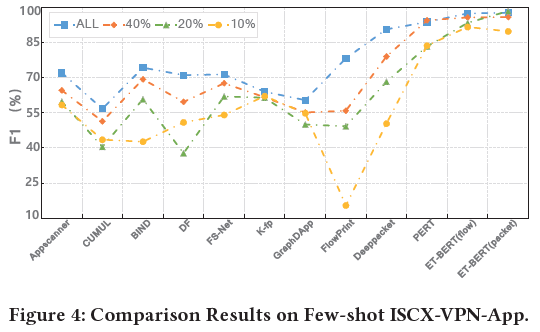

如图 4 所示,通过压缩训练数据规模和实验测试,研究者表明 ET-BERT 相比其他典型代表方法在 3 种不同规模的小样本场景下展现的性能更加稳定,即使在 10%的数据规模量级(50 左右)下仍保持 90%左右的 macro-F1 结果。

结果可视化对比的质量

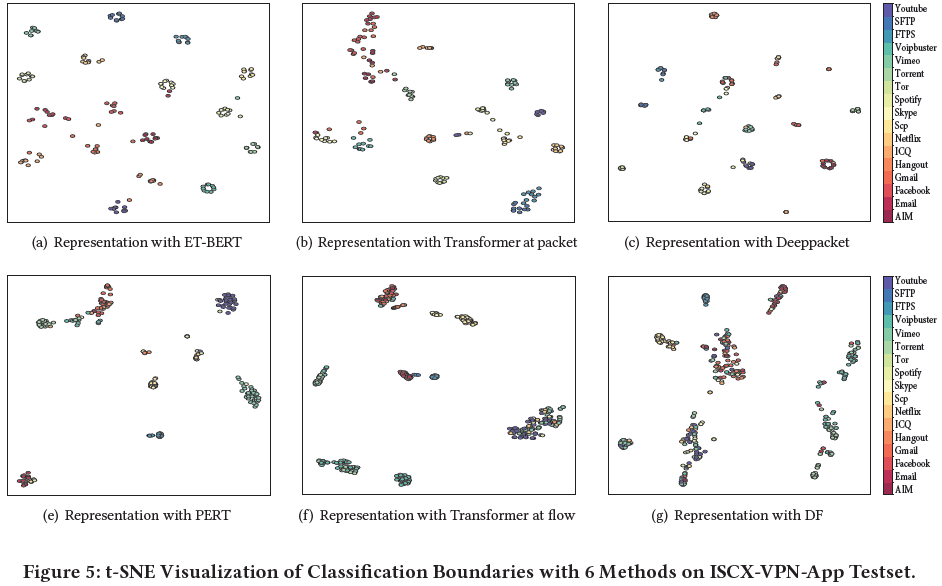

如图 5 所示,研究者通过分类结果的可视化展示 ET-BERT 的性能表现出色,在多类别的样本类内距离以及类间距离的边界识别更加清晰,对于流量特征近似的类别也能够保持较低的错检率。

总结

研究者提出了一种面向加密流量分类的流量表征模型 ET-BERT,该模型采用基于 Transformer 网络的预训练-微调设计结构,极大改变了传统流量分类研究中依赖大规模标注流量和大量专家经验知识的问题。ET-BERT 具有良好的泛化性,能够适应不同的加密流量场景,包括新型加密协议,在未来全加密网络中应用更加普适和可靠的网络行为分析技术具有较好的启示作用。

此外,研究者表示当前工作相比于统计特征构建的方法,在可解释和易理解方面还存在不足,同时还未对数据毒化和场景漂移等不稳定因素干扰展开进一步测试验证。研究者计划在未来的研究工作中尝试解决这些问题并进一步保障在全加密网络中的可靠和可用。

论文链接:https://arxiv.org/abs/2202.06335

代码链接:https://github.com/linwhitehat/ET-BERT

作者与团队简介:

林鑫杰,中国科学院信息工程研究所(中国科学院大学网络空间安全学院)在读博士研究生,在熊刚老师的网络行为分析与对抗组、于静老师的跨模态智能研究组开展研究,研究方向包括加密流量分析和预训练学习,个人 GitHub 主页:https://github.com/linwhitehat。

中科院信息工程研究所网络行为分析与对抗团队的主要研究领域为网络测量与行为分析、信息对抗理论与技术、网络取证技术、海量数据挖掘与分析等,相关研究工作在 USENIX Security、WWW、INFOCOM、Computers & Security、ACSAC、WWWJ、CIKM、计算机学报、RAID、IWQoS 等国内外重要会议期刊发表。

中科院信息工程研究所跨模态智能研究组的主要研究领域为多模态信息表示、记忆、推理、生成和积累等,应用场景包括跨模态信息检索、视觉问答/对话、图像/视频描述生成、视觉场景图生成等,相关研究工作在 CVPR、ICML、AAAI、IJCAI、ACM MM、TIP、TMM 等国际重要会议和期刊发表,研究组主页:https://mmlab-iie.github.io/。