继 11 月初零一万物发布性能优异的 Yi-34B 基座模型后,Yi-34B-Chat 微调模型在 11 月 24 日开源上线,而各家测评平台也相继给出了 Yi-34B-Chat 的测试结果。

模型地址:

https://www.modelscope.cn/organization/01ai

各家测评结果

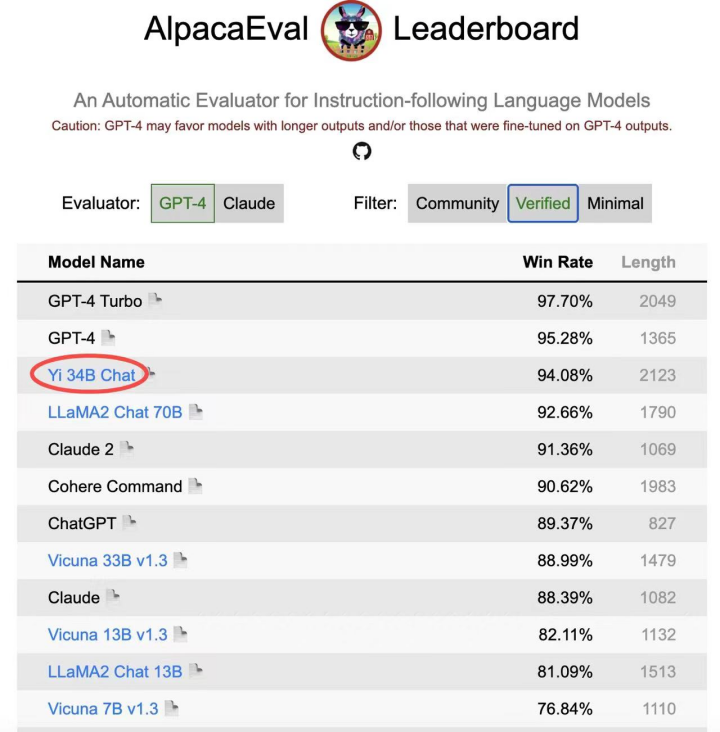

在斯坦福大学研发的大语言模型评测 AlpacaEval Leaderboard 中,Yi-34B-Chat 以 94.08%的胜率,超越 LLaMA2 Chat 70B、Claude 2、ChatGPT,在 Alpaca 经认证的模型类别中,成为世界范围内仅次于 GPT-4 英语能力的大语言模型。

AlpacaEval Leaderboard 排行榜(发布于 2023 年 12 月 7 日)

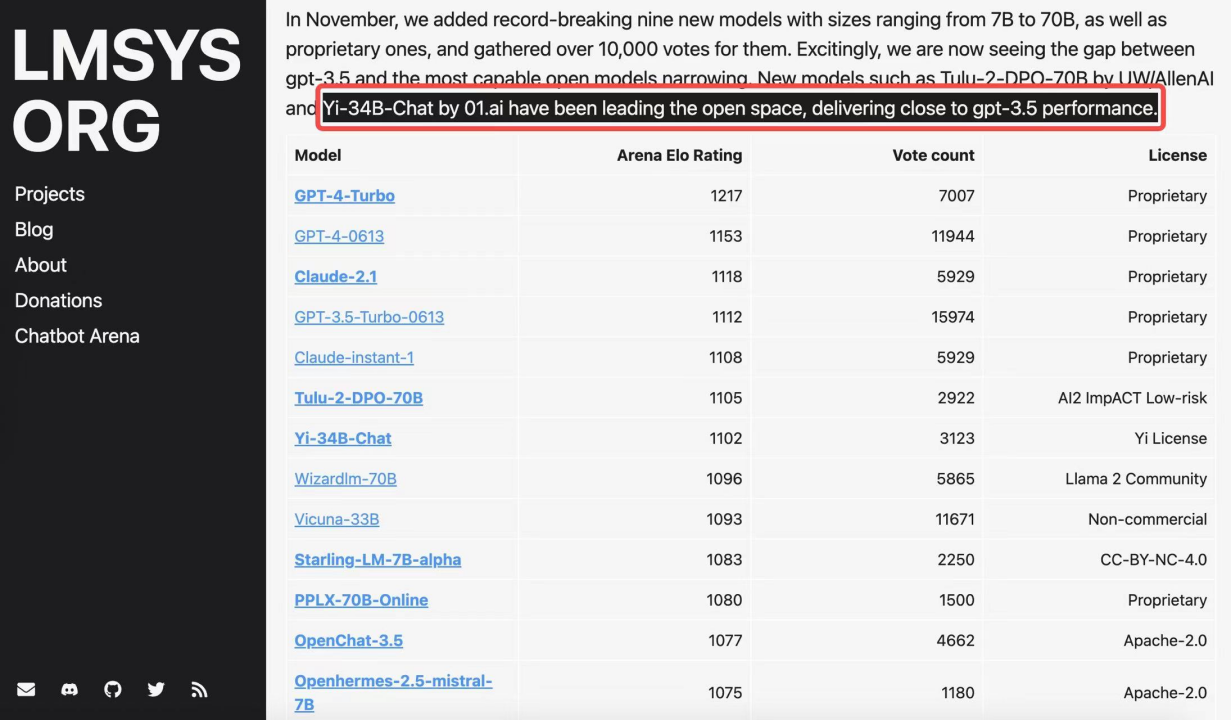

同一周,在加州大学伯克利分校主导的 LMSYS ORG 排行榜中,Yi-34B-Chat 也以 1102 的 Elo 评分,晋升最新开源 SOTA 开源模型之列,性能表现追平 GPT-3.5。

伯克利 LMSYS ORG 排行榜采用了一种最为接近用户体感的 “聊天机器人竞技场” 特殊测评模式,即让众多大语言模型在评测平台随机进行一对一 battle,通过众筹真实用户来进行线上实时盲测和匿名投票。11 月份,经 25000 个真实用户投票计算了 20 个大模型的总得分。Elo 评分越高,说明模型在真实用户体验上的表现越出色。

在开源模型中,Yi-34B-Chat 在英语能力上进入前十。LMSYS ORG 在 12 月 8 日官宣 11 月份总排行时评价:“Yi-34B-Chat 和 Tulu-2-DPO-70B 在开源界的进击表现已经追平 GPT-3.5”。

LMSYS ORG 榜单(发布于 2023 年 12 月 8 日)

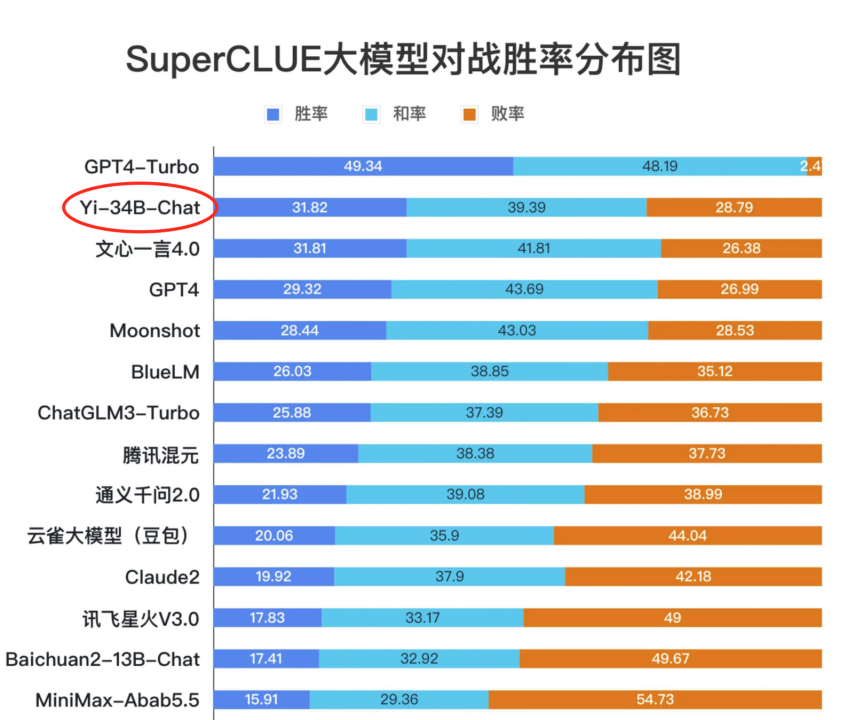

在针对中文能力的排行榜方面,SuperCLUE 从基础能力、专业能力和中文特性能力三个不同的维度,评估模型的能力。根据 11 月底发布的《SuperCLUE 中文大模型基准评测报告 2023》,11 月下旬首度发布的 Yi-34B Chat,迅速晋升到和诸多国产优秀大模型齐平的 “卓越领导者” 象限。在多项基准评测中的 “SuperCLUE 大模型对战胜率” 这项关键指标上,Yi-34B-Chat 取得 31.82%的胜率,仅次于 GPT4-Turbo。

中文 SuperCLUE 排行榜(发布于 2023 年 11 月 28 日)

值得注意的是,Yi-34B-Chat 微调模型为开发者提供了 4bit/8bit 量化版模型。Yi-34B-Chat 4bit 量化版模型可以直接在消费级显卡(如 RTX3090)上使用。

真实场景如何

Yi-34B-Chat 模型实力在不同的对话场景中实力如何?来看几个更直观的问题演示。

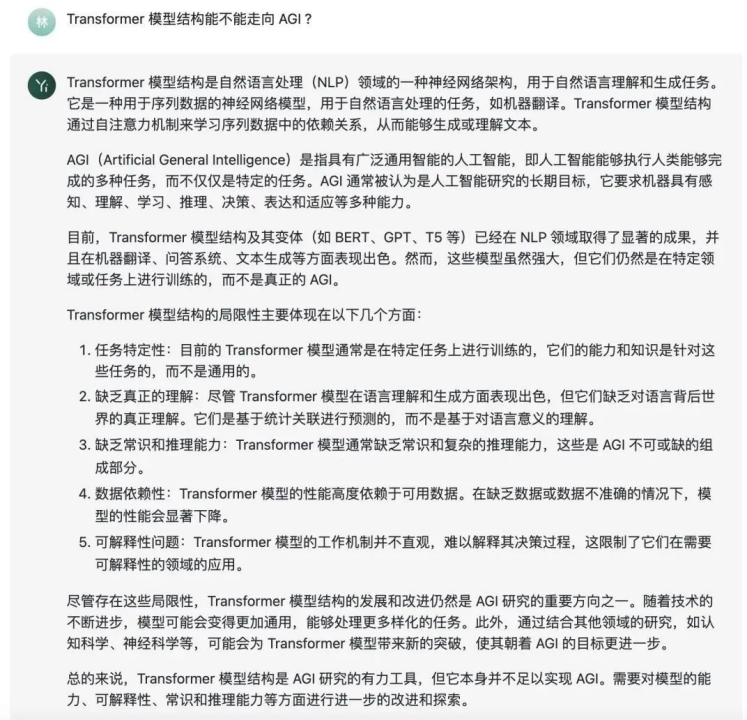

知识与生成

问:Transformer 模型结构能不能走向 AGI ?

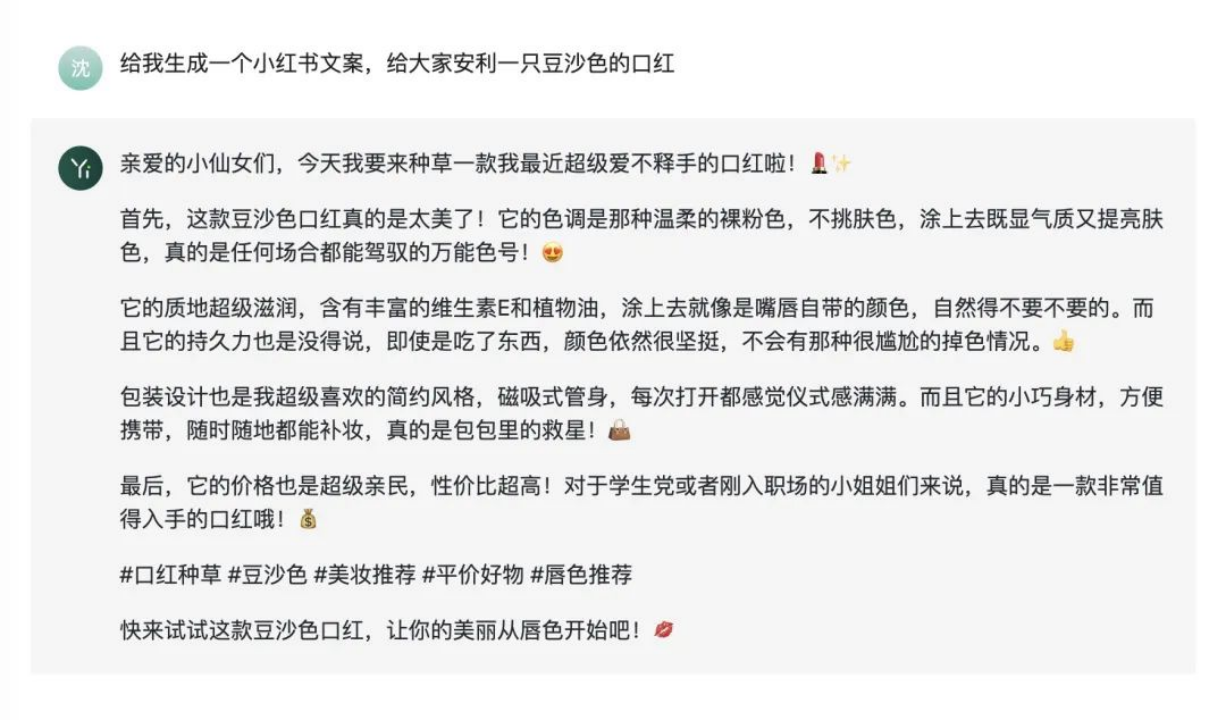

创意文案

问:给我生成一个小红书文案,给大家安利一只豆沙色的口红。

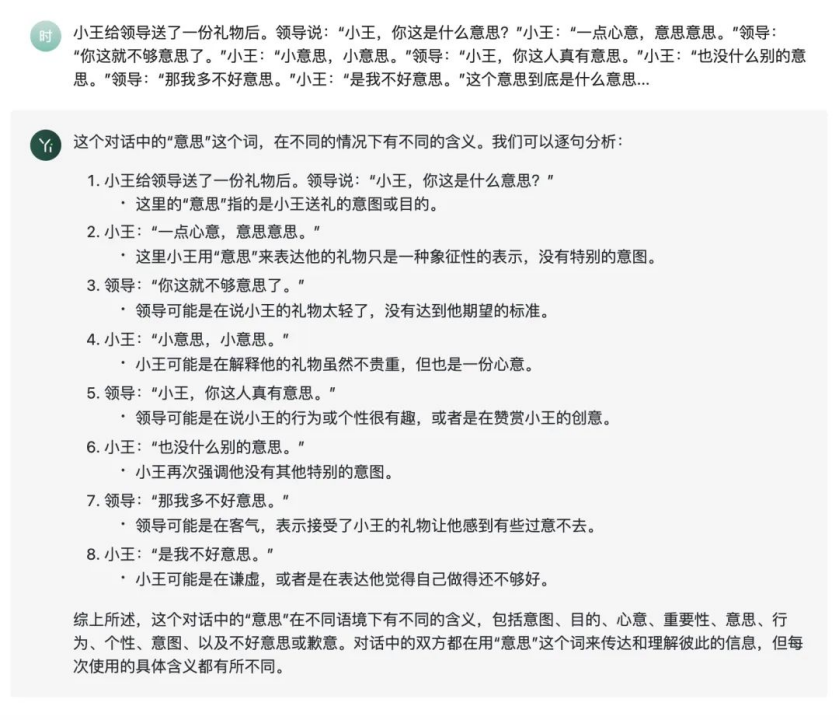

中文理解

问:小王给领导送了一份礼物后。领导说:“小王,你这是什么意思?”小王:“一点心意,意思意思。”领导:“你这就不够意思了。”小王:“小意思,小意思。”领导:“小王,你这人真有意思。”小王:“也没什么别的意思。”领导:“那我多不好意思。”小王:“是我不好意思。”这个意思到底是什么意思?

据零一万物介绍,除了 Yi 系列强基座的贡献以外,Yi-34B-Chat 模型的效果还得益于其人工智能对齐(AI Alignment)团队采用了一系列创新对齐策略。通过精心设计的指令微调流程,不仅强化了模型在理解和适应人类需求方面的能力,还使得模型与人类价值观对齐,包括帮助性(Helpful),可靠性(Honest),无害性(Harmless)等。

在强基座设定下,该团队采用了一种轻量化指令微调方案,该方案涵盖了单项能力提升和多项能力融合两个阶段。

其中,单项能力包括通用指令跟随、创意内容生成、数学、推理、编程、泛 COT、对话交互等,团队通过大量的消融实验,针对模型单能力构建和多能力融合总结了独家认知经验;在多能力融合阶段,团队采用网格搜索的方法来决定数据配比和超参数的设置,通过基准测试和自建评测集的结果来指导搜索过程,成功实现模型的多能力融合。

在数据的量和质方面,零一万物团队认为,数据质量比数量重要,少量高质量数据比大量低质量数据更好,仅需少量数据(几条到几百条)就能激发模型特定单项能力。团队通过关注超出模型能力的“低质量”数据,来减少了模型“幻觉”。

在指令多样性与难度方面,团队在各能力项下构建任务体系,实现训练数据中的指令均衡分布,提升模型泛化性。此外,团队发现训练数据的风格会影响模型收敛速度和能力上限的逼近程度,因此统一了回复风格,比如重点设计了 CoT 的回复风格,实现在轻量 SFT 情况下,避免了风格不一致加剧模型的“记忆”现象。

开源“满月”:有赞扬,也有质疑

Yi 模型发布之初便是开源的。开源首月,Yi 模型在 Hugging Face 社区下载量为 16.8 万,魔搭社区下载量 1.2 万,在 GitHub 获得超过 4900 个 Stars。

多家知名公司和机构推出了基于 Yi 模型基座的微调模型,比如猎豹旗下的猎户星空公司推出的 OrionStar-Yi-34B-Chat 模型、南方科技大学和粤港澳大湾区数字经济研究院(简称 IDEA 研究院)认知计算与自然语言研究中心(简称 CCNL 中心)联合发布的 SUS-Chat-34B 等。

知名技术写作者苏洋表示,根据他的近期观察,Hugging Face 榜单中的前三十名有一半多是 Yi 和其他用户微调的 Yi-34B 的变体模型,原本占据榜单头部的 68B 和 70B 模型的数量目前只留有几个。

苏洋曾尝试使用家里本地的机器,在纯 CPU 环境、CPU & GPU 混合环境下对 Yi 模型进行测试,“结果比想象中要好。尤其是社区中的 finetune 后的版本,在对新闻、研究报告的摘要总结方面,对非结构化的信息中的实体识别和抽取上表现非常不错。”同时,苏洋也指出,可能是由于零一在训练过程中,出于安全考虑,过滤太多语料的缘故,一些本土化的内容仍然不够深入。

根据亲身体验,苏洋总结道,34B 普通用户努努力还是能自己相对低成本跑起来的,68 B 和 70B 的模型想要本地运行,需要更多的资源,但目前分数上跟 34B 的拉不开太多差距,大概就是三四分平均分。

开源后,Yi 系列模型也遭到了一些质疑。

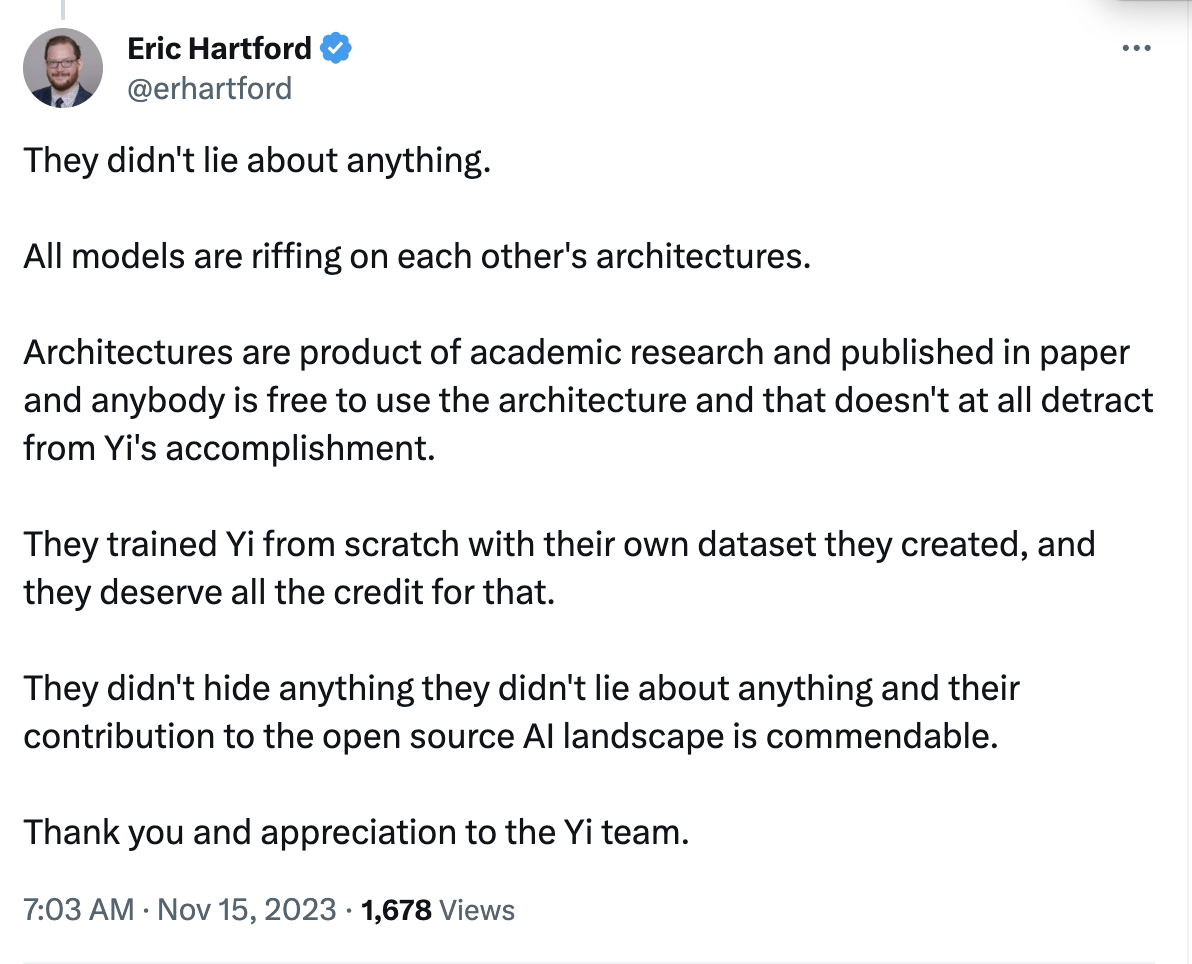

开发者 Eric Hartford 敏锐发现了模型存在的一个问题:Yi 模型使用了与 LLaMA 模型完全相同的架构,只是将两个张量改了名字。由于围绕 LLaMA 架构有很多投资和工具,保持张量名称的一致性是有价值的。Eric 建议,在 Yi 被广泛传播前,及时恢复张量名称。

Eric 没有预想到,他的这个建议引来了关于 Yi 模型“抄袭”LLaMA 的质疑。

之后,零一万物很快便在各开源平台重新提交模型及代码,完成了开源社区的版本更新。零一万物表示,一个模型核心技术护城河是在架构之上,通过数据训练获得的参数和代码。在沿用了开源社区普遍使用的 LLaMA 架构之上,零一万物团队从零开始,用高质量的数据集、自研训练科学和 AI Infra 打造了 Yi-34B 在内的系列模型。为了执行对比实验的需要,对部分推理参数进行了重新命名。原始出发点是为了充分测试模型,而非刻意隐瞒来源。

Eric 后来发推特为Yi辩护称,“他们没有在任何事情上撒谎。所有的模型都是在相互借鉴架构。架构是学术研究的产物,已经发表在论文中,任何人都可以自由使用,这丝毫不减损 Yi 团队的成就。他们从零开始使用自己创建的数据集训练 Yi,对开源领域的贡献是值得赞扬的。”

他还补充道,“使用 Llama 架构没有任何问题。训练才是关键。Yi 给了我们目前可获得的最佳模型,没有任何可抱怨的。”

更多阅读:

零一万物回应“套壳 Llama”争议:基于 GPT 研发,对模型和训练的理解做了大量工作