AIGC 的爆发除了带来算力上的挑战,对网络的要求也达到了前所未有的高度。

星脉高性能计算网络:最大带宽达 3.2T,可支持 10 万卡超大算力集群

6 月 26 日,腾讯云首次对外完整披露自研星脉高性能计算网络:星脉网络具备业界最高的 3.2T 通信带宽,能提升 40%的 GPU 利用率,节省 30%~60%的模型训练成本,为 AI 大模型带来 10 倍通信性能提升。基于腾讯云新一代算力集群 HCC,可支持 10 万卡的超大计算规模。

AIGC 的火爆带来 AI 大模型参数量从亿级到万亿级的飙升。为支撑海量数据的大规模训练,大量服务器通过高速网络组成算力集群,互联互通,共同完成训练任务。大集群不等于大算力,相反,GPU 集群越大,产生的额外通信损耗越多。大带宽、高利用率、信息无损,是 AI 大模型时代网络面临的核心挑战。

千亿、万亿参数规模的大模型,训练过程中通信占比最大可达 50%,传统低速网络的带宽远远无法支撑。同时,传统网络协议容易导致网络拥塞、高延时和丢包,而仅 0.1%的网络丢包就可能导致 50%的算力损失,最终造成算力资源的严重浪费。

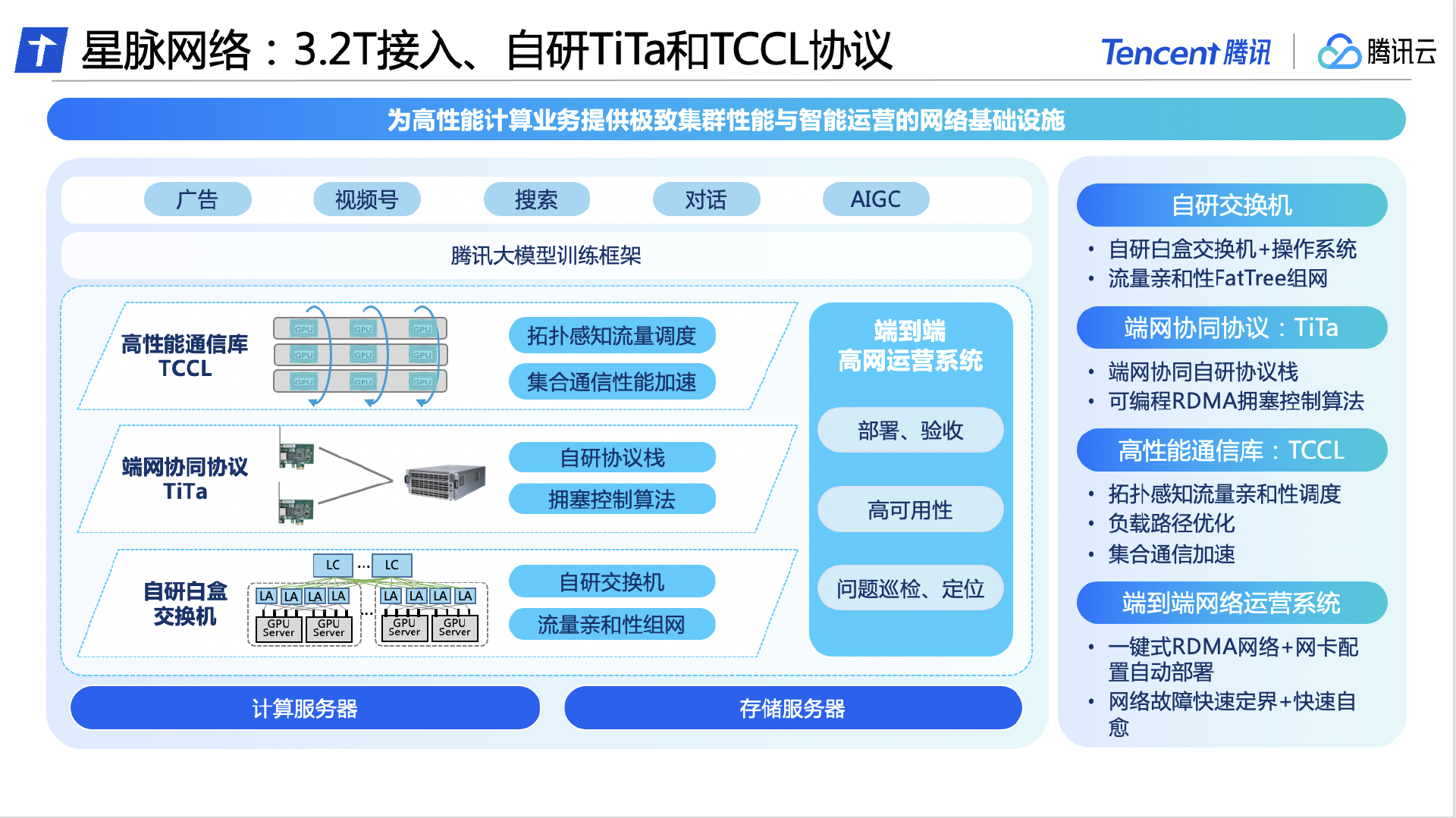

基于全面自研能力,腾讯云在交换机、通信协议、通信库以及运营系统等方面,进行了软硬一体的升级和创新,率先推出业界领先的大模型专属高性能网络——星脉网络。

腾讯云副总裁王亚晨表示:“星脉网络是为大模型而生。它所提供的大带宽、高利用率以及零丢包的高性能网络服务,将助力算力瓶颈的突破,进一步释放 AI 潜能,全面提升企业大模型的训练效率,在云上加速大模型技术的迭代升级和落地应用。”

在硬件方面,星脉网络基于腾讯的网络研发平台,采用全自研设备构建互联底座,实现自动化部署和配置。

在软件方面,腾讯云自研的 TiTa 网络协议,采用先进的拥塞控制和管理技术,能够实时监测并调整网络拥塞,满足大量服务器节点之间的通信需求,确保数据交换流畅、延时低,实现高负载下的零丢包,使集群通信效率达 90%以上。

此外,腾讯云还为星脉网络设计了高性能集合通信库 TCCL,融入定制化解决方案,使系统实现了微秒级感知网络质量。结合动态调度机制合理分配通信通道,可以避免因网络问题导致的训练中断等问题,让通信时延降低 40%。

网络的可用性,也决定了整个集群的计算稳定性。为确保星脉网络的高可用,腾讯云自研了端到端的全栈网络运营系统,通过端网立体化监控与智能定位系统,将端网问题自动定界分析,让整体故障的排查时间由天级降低至分钟级。同时,大模型训练系统的整体部署时间从 19 天缩减至 4.5 天,保证基础配置 100%准确。

腾讯数据中心网络技术演进历程

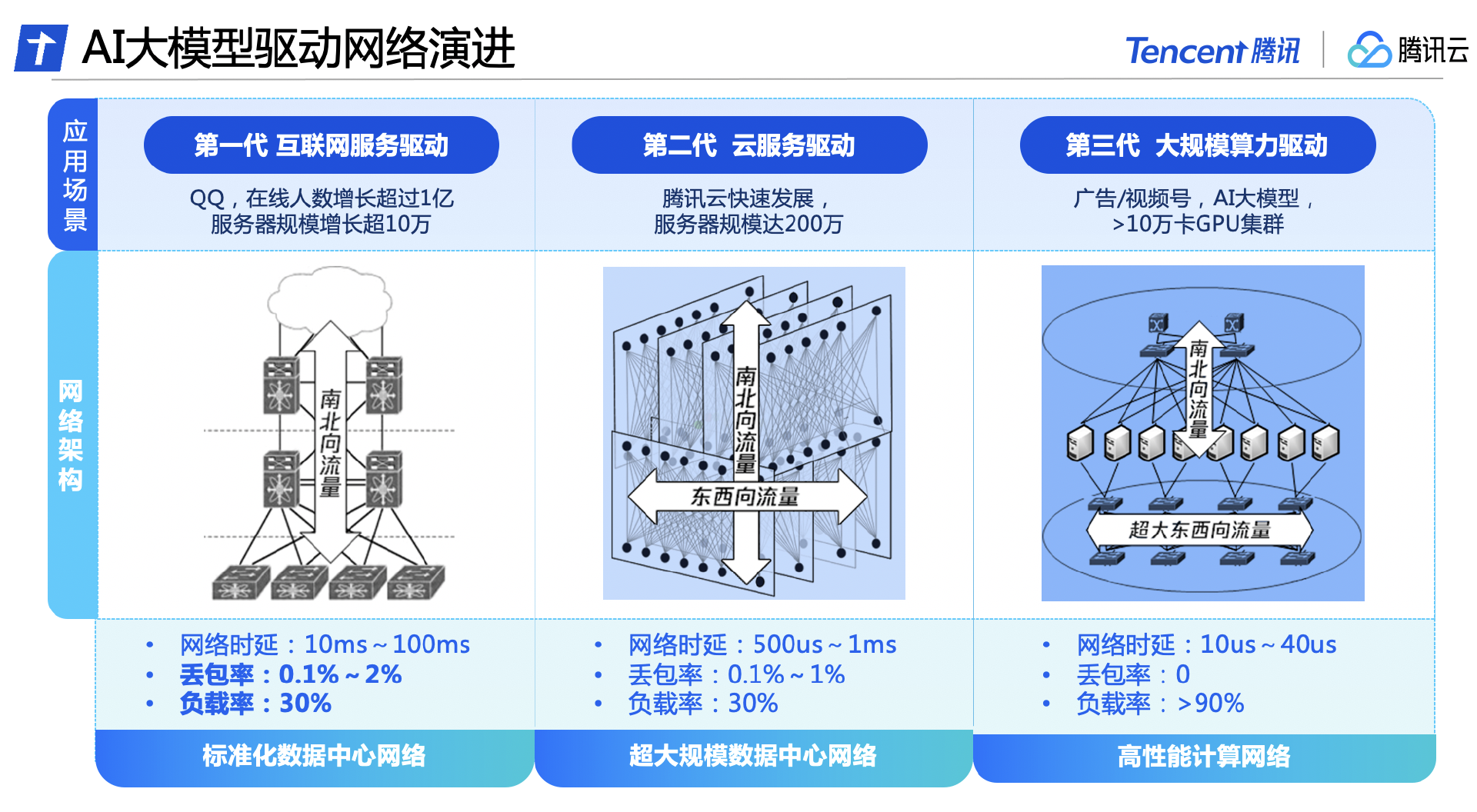

星脉网络全方位的升级背后,是腾讯数据中心网络历经三代技术演进的成果。

在腾讯发展初期,数据中心网络流量主要由用户访问数据中心服务器的南北向流量构成,网络架构以接入、汇聚、出口为主。这一阶段主要使用了商用网络设备,搭建标准化数据中心网络,支撑 QQ 在线人数增长超过 1 亿,服务器规模增长超 10 万。

随着大数据和云计算的兴起,服务器之间的东西向流量逐渐增多,云租户对网络产生了虚拟化和隔离的要求。数据中心网络架构逐渐演变为同时承载南北向和东西向流量的云网络架构,腾讯云构建了全自研网络设备与管理系统,打造超大规模数据中心网络,服务器规模近 200 万台。

如今随着AI大模型的出现,腾讯云在国内率先推出高性能计算网络,采用东西向、南北向流量的分离架构。构建了独立的超大带宽、符合 AI 训练流量特征的网络架构,并配合自研软硬件设施,实现整套系统的自主可控,满足超强算力对网络性能的新需求。

日前,腾讯云发布的新一代 HCC 高性能计算集群,正是基于星脉高性能网络打造,可以实现 3.2T 超高互联带宽,算力性能较前代提升 3 倍,为 AI 大模型训练构筑可靠的高性能网络底座。

未来,腾讯云还将持续投入基础技术的研发,为各行各业的数智化转型提供有力的技术支撑。