Mistral AI 是一家总部位于巴黎的初创公司,由 Meta 和谷歌的研究人员于七个月前创立。目前,该公司已成功筹集 3.85 亿欧元(约合 4.15 亿美元),再次凸显了人们对生成式 AI 的浓厚兴趣。

据两位知情人士透露,这笔交易将该公司的估值提升至约 20 亿美元,而该公司目前拥有 22 名员工。投资者阵容中有硅谷风险投资公司 Andreessen Horowitz 和 Lightspeed Venture Partners,还包括 Salesforce、法国巴黎银行等众多投资机构。

令人瞩目的是,这家初创公司的估值在短短的六个月内增长了七倍以上。仅在今年夏季,公司就成功完成了一轮 1.05 亿欧元(约合 1.13 亿美元)的种子资金融资,当时公司的估值约为 2.6 亿美元。

同时,Mistral AI 还推出了新型 Mixtral 8x7B LLM。这款模型被称为“权重开源(open weights)”模型,设定了新的性能标准,并在其商业平台开放了访问。

媲美 GPT3.5 的“开放权重”模型

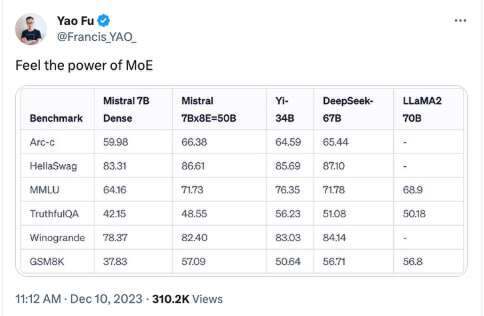

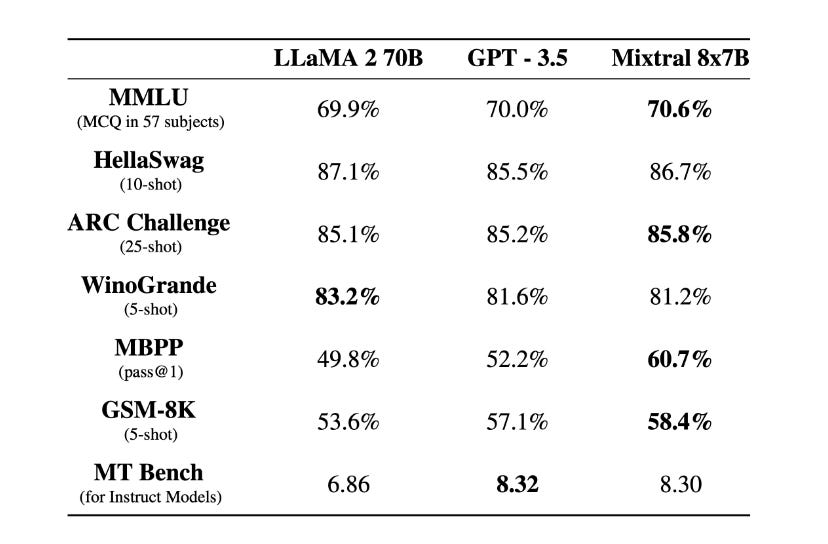

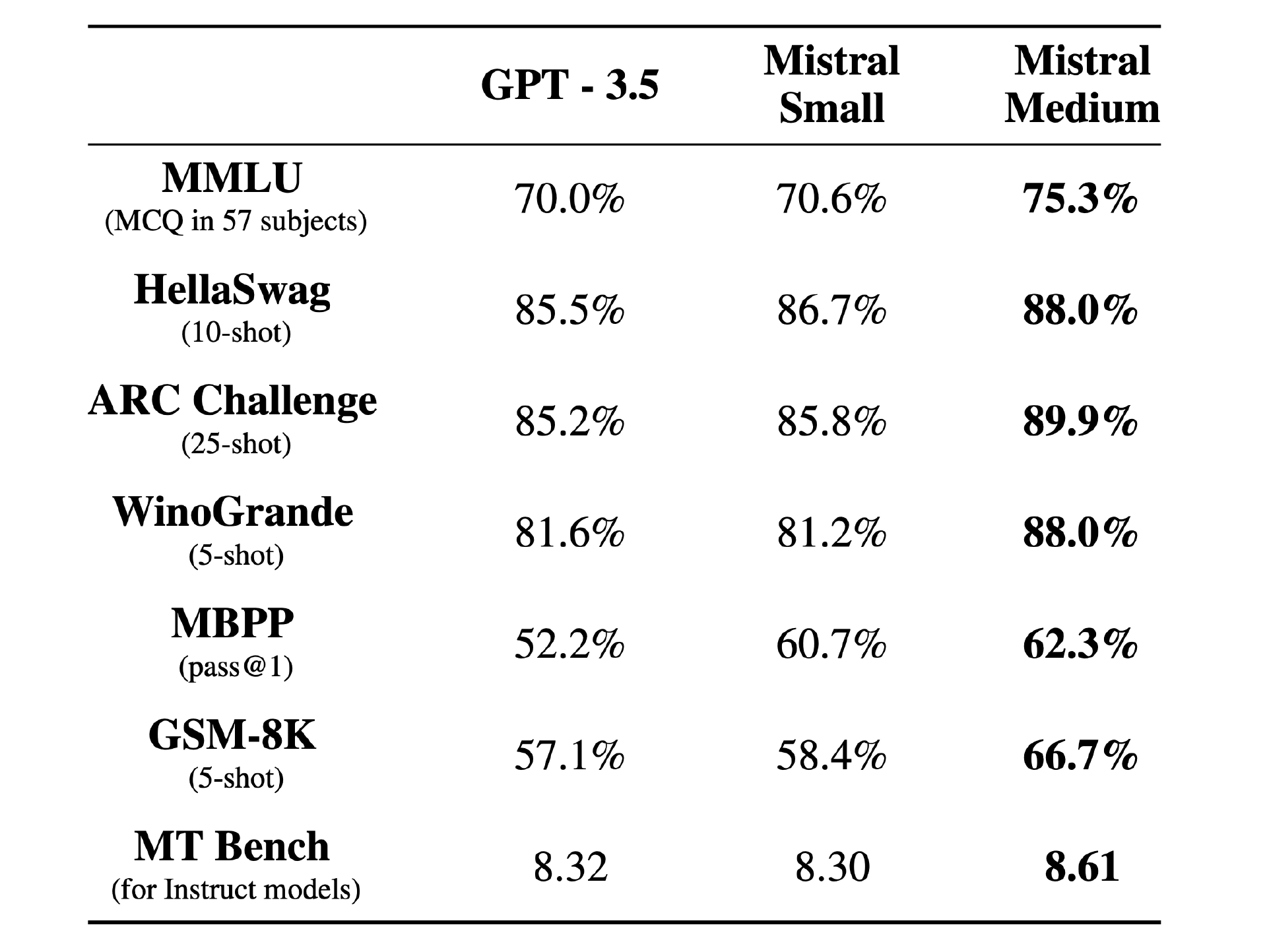

Mistral AI 发布了其名为 Mixtral 8x7B 的新模型,与 Meta 的 Llama 2 和 OpenAI 的 GPT-3.5 模型相比性能更佳。测试结果显示,Mixtral 的性能与其他两个选项相当,甚至更为出色,并且成本和延迟更低。

Mistral AI 官方宣称,这是一种高质量稀疏专家混合模型 (SMoE),可以在 Apache 2.0 许可证下用于商业用途。并且,Mixtral 在大多数基准测试中都优于 Llama 2 70B,推理速度提高了 6 倍。

Mistral AI 公司特别强调,“它是最强大的开放权重模型,具有宽松的许可证,也是成本/性能权衡方面的最佳模型。特别是,它在大多数标准基准测试中匹配或优于 GPT3.5。”

截图源自:https://mistral.ai/news/mixtral-of-experts/

Mixtral 具有 32k token 上下文,可以处理英语、法语、意大利语、德语和西班牙语,代码生成表现出色。同时发布了 Instruct 版本的微调模型,MT-Bench 8.3 分。

Mistral 表示,Mixtral 共 46.7B 参数,但每 token 仅使用 12.9B,意味着等同于 12.9B 的推理速度和成本。

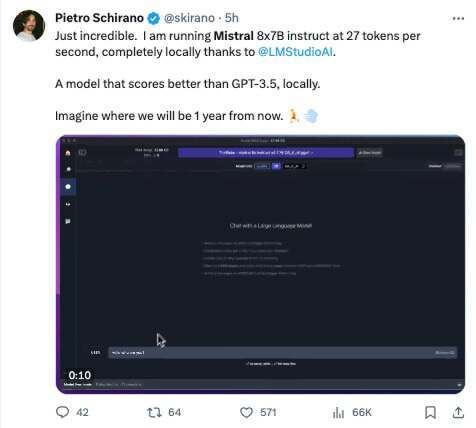

AI 领域的玩家已经开始下载、运行、尝试 Mixtral 8x7B,并对其性能和成本优势赞不绝口:

然而,值得注意的是,在官方给出的测试结果中有一个缺失,即 TruthfulQA,通常用于测试大模型中不重复常见在线错误信息的能力。尽管如此,Mistral 仍强调,与 OpenAI 和 Meta 的选项相比,其模型的运行成本要低得多,这是一个明显的优势。

开放平台

同一天,Mistral 还发布了其开放平台 La plateforme,并上架了三款模型。

Mistral-tiny:最具成本效益,目前提供 Mistral 7B Instruct v0.2,它是 Mistral 7B Instruct 的更新小版本。Mistral-tiny 仅适用于英语,在 MT-Bench 上获得 7.6 分。

Mistral-small:Mixtral 8x7B,能处理英语/法语/意大利语/德语/西班牙语和代码,并在 MT-Bench 上获得 8.3 分。

Mistral-medium:最高档原型模型,能处理英语/法语/意大利语/德语/西班牙语和代码,并在 MT-Bench 上获得 8.6 分。

该公司同时提供了 embed endpoint,一个具有 1024 嵌入维度的嵌入模型,设计有检索能力,MTEB 55.26 分。

开源并不意味着 Mistral AI 回避商业化。虽然 Mistral AI 有两个模型可以直接下载,但他们的最佳模型现在只能通过 API 访问:该公司计划从其基础模型中赚钱。这就是 Mistral AI 今天开放其开发者平台测试版的原因。有了这个平台,其他公司将能够通过 API 付费使用 Mistral AI 的模型。

“我们的 API 遵循我们最亲爱的竞争对手最初提出的流行聊天界面的规范。我们提供了 Python 和 Javascript 客户端库,以查询我们的终端节点。”

“每个 endpoint 都在性能和价格之间进行了不同的权衡。”

公司小,但令人瞩目

Mistral AI 也被称为“欧洲 OpenAI”,由来自 Meta Platforms 和 Alphabet 的几位前研究人员 Arthur Mensch(现任 CEO)、Guillaume Lample 和 Timothee Lacroix 共同创立,公司成立于 2023 年 5 月,专门开发大语言模型及各类 AI 技术。Mistral 这个名号来自北方寒冷的季风,也体现了他们想要在 AI 领域占据一席之地的愿望。

6 月,Mistral AI 在拿下 1.13 亿美元巨额种子融资后引发业界轰动,公司估值也瞬间来到 2.6 亿美元。彼时,该公司刚刚成立,员工仅 6 人,还未做出任何产品,仅仅凭借着 7 页 PPT 就斩获了巨额融资。

虽然 Mistral AI 目前人员数量也只有二十来人,却以较小的规模成功地获得了 20 亿美元的估值,并轻松地推出了性能最高的 7B 模型和 8x7B MOE 模型。“我认为这可能对 OpenAI 来说是一个比 Google 或 Anthropic 更大的潜在威胁。”Hacker News 网友评论。“考虑到最近的大额投资,我认为他们将能够 a)在不久的将来扩展到应对合理的流量负载,b)吸引最顶尖、最聪明的研究人员,并以各种惊人和戏剧性的方式引起这个行业的关注。”

Mistral 公司 CEO、前 DeepMind 研究科学家 Mensch 表示,这家企业的使命是“打造出能够解决现实世界问题的下一代 AI 系统”,并在创立之初就坚定了开源路线。他们于今年 9 月发布了自家首个大模型 Mistral 7B,该模型号称是“最强 7B 开源模型”。

英伟达 Senior Research Scientist Jim Fan 评论说,Mistral 成功要素之一就是成立时机无可挑剔:诞生在开源和闭源争议中,并由精干团队推动。

另外,每个月都会有几十款模型问世,但能引起大众向往的很少,而 7B 和 7B-MoE(相当于 12B 密集)却对基层 AI 工程师来说更为友好,更容易构建。而且作为欧洲“本土化”的语言模型,Mistral AI 也做到了差异化发展。可以说,该公司强大的初始团队和雄心勃勃的发展目标,已经使其成为当前乃至未来几年中最值得关注的 AI 初创力量之一。

参考链接:

https://mistral.ai/news/mixtral-of-experts/

https://mistral.ai/news/la-plateforme/

https://twitter.com/DrJimFan/status/1734269362100437315

https://www.nytimes.com/2023/12/10/technology/mistral-ai-funding.html