“SB 1047 和 AB 3211 将会消灭加州的开源。”有网友评价道。

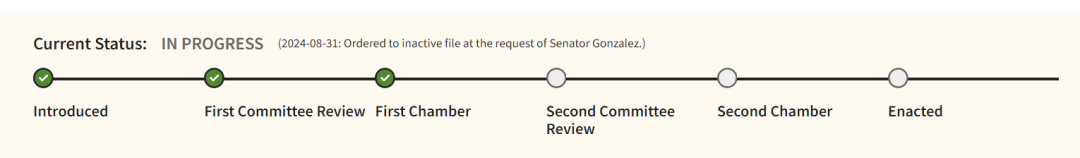

就在人们为 SB 1047 号法案而抓狂之时,另一项加州法案 AB 3211 已经悄然被递交至立法机构,而且似乎即将获得通过。(SB-1047 法案全称“前沿 AI 模型安全创新法案”,旨在对投资超过 1 亿美元的或具备一定计算能力的开发者建立安全准则,以保障大规模 AI 模型的安全性)

AB 3211 这项法案将产生更大的影响,因为它将使得任何尚未全面部署强大 AI 水印机制的 AI 图像生成系统、服务、模型或者模型托管站点沦为非法实体,几乎不可能在加州范围内正常运营。此项法案要求通过此类水印系统嵌入非常具体、肉眼无法察觉且难以删除的元数据,以将图像标识为 AI 生成,同时提供关于图像生成方式、时间及服务的其他信息。“元数据”是指有关数据的结构性或描述性信息。

压力到底给到了谁?

"这项要求在技术层面严重缺乏可行性。想要在生成图像文件(或者任何其他数字文件)时,向其中附加或者嵌入无法删除的元数据几乎没有可能——之前遭遇失败的 DRM 方案已经证明了这一点。"网友 Yenta Magenta 分析称。

Magenta 表示,这项法案的要求其实可以轻松被简单的屏幕二次截图所破解,而且哪怕开发人员设计出了真正不可破解的水印,其落地要求恐怕也将远远超过大多数模型构建者,特别是开源社区的承受能力。该法案还要求全体模型创建者 / 提供者开展广泛的对抗性测试,并开发及公开用于检测其模型或系统生成内容的工具。虽然法案中的其他条款将被推迟至 2026 年执行,但前面提到的大部分主要条款都很可能将在法案通过后立即生效。

如果目前掌握的法案内容准确无误,那就意味着市面上几乎全部现有 Stable Diffusion 模型、微调及 LoRA 在加州都将被定义为非法。而 CivitAI、Hugging Face 等网站则有义务过滤加州居民生成的内容,甚至一刀切阻止这部分用户的访问。(考虑到筛查的成本太高,一刀切阻止恐怕会成为大概率事件。)

在水印要求方面,法案似乎也没有列举任何涉及技术可行性的例外条款。Magenta 表示,鉴于法案所要求的高度具体且可靠的技术尚不存在,甚至可能永远不会出现(特别是在开源技术领域),至少就目前来讲,该项法案实际上是一纸针对加州 AI 图像生成业务的全面禁令。由此引发的诉讼纠纷也将只是时间问题。

前微软工程师 Jacob Miller 就表示,"加州的 AB 3211 法案旨在要求图片中的元数据区分 AI 生成图片和“真实”图片,并要求平台披露是否真实。我认为无法创建一种万无一失的方法来追踪这一点。感觉它最终产生的问题会比它解决的问题更多。不可避免地,会有一种生成具有元数据图像的方法,这些元数据被认为是真实的,此时平台声明‘这是一张真实的图片’会比根本没有免责声明更糟糕。我认为这是一件意图是好的、但现实却是加剧问题而不是提供帮助的事情。“

根据 TechCrunch 报道,微软、OpenAI 和 Adobe 目前都对这项措施表示支持。“这几乎肯定是因为他们意识到没有任何开源图像生成模型或者服务能够满足技术要求,所以这项法案反而成为帮助他们打击开源竞争对手的有力武器。这可能意味着加州一切开源 AI 图像模型都将宣告终结,甚至更多想在加州从事这项业务的公司也将被一体叫停。换句话说,这项法案很可能成为我们迄今为止在 AI 技术领域见证过的,最大的监管 / 压制性威胁。”Magenta 分析称。

目前尚不清楚该法案的拟定者(或者可能修改法案条款的三个阶段 )是否具备相关技术背景,以理解法案内容的矫枉过正与无法实现。如果他们确实具备这样的专业知识,那么从结果上看,此项法案的设计本身就是要出台一项隐性的全面禁令。

此外,该项法案将禁止销售任何未采用图像认证系统的新型静态或视频相机。但从条款上看情况似乎还有余地,毕竟相关规定还要过几年才会生效,而且只适用于“新制造”的设备。但“新制造”的定义仍含糊不清,意味着想要在法律生效后购买此前生产的旧机型以节约成本的买家,其行为很可能在加州被定义为非法。另外,考虑到手机也属于录制设备,这甚至会严重限制加州居民合法购买智能手机。

该法案还将对一切在加州拥有 200 万或者更多用户的大型在线社交媒体平台设定严格要求,包括检查其元数据以裁定哪些图像属于 AI 生成,并要求这些平台明确将其标注出来。任何无法确认为非 AI 生成的图像则应被标记为来源不明。

鉴于加州对于社交媒体平台的定义较为宽泛,因此从 Facebook 到 Reddit,甚至 WordPress 乃至其他拥有活跃评论区的网站和服务都有可能被划入管控范畴。“毫无疑问,这将成为一场席卷技术与言论自由的监管噩梦。”

“这个法案是一份疯狂的愿望清单——最重要的是,它要求平台解决许多项目正在尝试解决的版本控制和出处问题。这是一个难题!加州正努力为世界树立糟糕的人工智能监管榜样。”网友 Himanshu Tyagi 评价道。

此项法案已经在加州议会以 62:0 票(80 名议员)的比例初步获得一致通过,目前来看法案很可能会以某种形式在加州参议院获得通过。但州长加文·纽森(Gavin Newsom)是否愿意签署这项严厉、侵犯隐私且具有巨大潜在破坏性的立法仍有待观察。

另外,不清楚这项法案应如何通过宪法审查,毕竟其条款似乎过于宽泛、缺乏技术可行性,同时也宪法第一修正案约定的权利有所冲突,甚至可以说代表着一种强制性的言论管控形式。但令人意外的是,电子前沿基金会(EFF)和美国公民自由协会(ACLU)似乎都没有对这项法案发表意见,至少从 2024 年 6 月加州参议院司法委员会的分析结果来看是如此。

此消息一出,已经有企业开始宣传自己加的产品了:Digimarc 水印技术以无与伦比的准确性、速度和规模识别和验证实体和数字资产,以应对当今复杂挑战。

对此,有网友嘲讽道:“是在蓝红绿通道上进行简单的图案注入,就像 1995 年那样吗?”

争议颇大的 SB 1047

如前文提及到的,加州议会及参议院已经通过《前沿 AI 模型安全创新法案(SB 1047)》,这也是美国首批重要的 AI 法规之一。

该法案一直是硅谷及其他地区的争论焦点,其要求在加州运营的 AI 企业在训练复杂的基础模型之前,必须实施一系列预防措施。具体包括能够快速完全关闭模型,确保模型免受“不安全的训练后篡改”,并部署测试程序以评估模型或其衍生版本是否容易“造成或被用于实施严重危害”。

SB 1047 的规则适用于世界上的大型 AI 模型:成本至少为 1 亿美元,并且在训练期间使用 10^26 FLOPS;或者是利用不少于 10^25 次整数或浮点运算三倍的计算能力,对范围内的模型进行微调而创建的人工智能模型。

对于开源模型及其衍生产品,该法案规定原始开发者应承担责任,除非另一位开发者再花费 1000 万美元创建原始模型的衍生产品。

加州则会成立新的机构——Frontier Models 委员会负责监督,该委员会将由 9 名成员管理,包括来自 AI 行业、开源社区和学术界的代表,由加州州长和立法机构任命。

该法案的主要作者、参议员斯科特·维纳 (Scott Wiener) 表示,SB 1047 是一项非常合理的法案,条款只是要求各大 AI 实验室做他们已经承诺要做的事情:测试自己的大模型是否存在灾难性的安全风险。“我们与各开源倡导者、Anthropic 公司以及其他组织共同努力,在过去整整一年间不断完善并改进该项法案。SB 1047 很好地反映了我们对于可预见 AI 风险的了解,应当颁布落地。”

被称为“人工智能教父”的人工智能研究人员 Geoffrey Hinton 和 Yoshua Bengio 都支持这项法案,但还有很多人反对:李飞飞认为,该法案将“损害我们刚刚起步的人工智能生态系统”;吴恩达认为,称该法案是“对开源的攻击”,开源模型可能会给其创建者带来额外的风险,因为像任何开放软件一样,它们更容易被修改并部署到任意和潜在的恶意目的;杨立坤则表示,SB 1047 将损害研究工作,并且是基于“少数妄想智囊团推动的‘生存风险’幻觉”

另外,越来越多的硅谷人士反对 SB 1047 法案,包括 OpenAI、Anthropic、政客 Zoe Lofgren 与 Nancy Pelosi 以及加州商会在内。8 月底,OpenAI 发布了一封公开信反对 SB 1047 法案。代表谷歌、苹果、亚马逊和其他大型科技巨头的贸易组织进步商会 ( Chamber of Progress ) 也发表公开信反对该法案,称 SB 1047 限制自由并“将科技创新赶出了加州”。

各方认为,这项法案总体过度关注灾难性危害,有可能会挤压小型开源 AI 开发组织的生存空间。作为回应,该法案也做出了修订,将潜在的刑事处罚更换为民事处罚,缩小了授予加州总检察长的执法权力,同时调整了加入法案中建议设立的“前沿模型委员会”的准入门槛。

根据《纽约时报》报道,这项 AI 安全法案即将被提交至加州州长加文·纽森处,由他在 9 月底之前决定其能否通过。

结束语

看得出来,加州立法机构在 AI 监管立法方面动作频繁,但是连出的两个“大招”反对声音都比较大。如何更好地对新技术进行有效监管,也是摆在大家面前的一个新命题。

参考链接: