“太令人印象深刻了!我想知道这个模型有多大。我注意到他们让它做的第一件事就是与能够控制世界生成的智能体交谈。天哪,甚至机器人也可以在我们工作的时候玩电子游戏!”

让网友如此兴奋的模型就是今天 DeepMind 发布的基础世界模型 Genie 2,这个模型能够生成各种可控制动作、可玩的 3D 环境,用来训练和评估具身智能体。基于单个提示图像,人类或 AI 智能体可以使用键盘和鼠标输入来玩它。

讲真,OpenAI 这次确实又狙击了谷歌一把。就在领导 Genie 2 项目的 DeepMind 研究科学家 Jack Parker-Holder 刚刚发推公布没多久,Altman 就宣布,从太平洋时间明天上午 10 点开始将进行为期 12 天的 OpenAI 活动,在每个工作日进行一个直播,内容包括最新技术或产品演示、重要发布和一些“小惊喜”。

一个预告就让网友开始将话题转向了“满血 o1、Sora、Dall-e 4、芯片计划”等等。但 Hacker News 上对 Genie 2 的讨论非常激烈。“这项研究的真正目标是开发出达到或超越人类对 3D 世界理解的模型——这是迈向 AGI 的关键一步。”还有网友说道,“演示非常棒。我想当我的孩子进入电子游戏黄金年龄时(再过个 5 年左右),我们将进入互动故事叙述的新黄金时代。”有网友说道。

没错,Genie 2 的重要应用场景就是游戏,其具备对象交互、复杂的角色动画、物理以及建模并预测其他智能体行为的能力。DeepMind 也承认了这点:“从我们早期与 Atari 游戏的合作,到 AlphaGo 和 AlphaStar 等突破性成果,再到我们与游戏开发者合作研究通用智能体,游戏一直是我们研究的重心。”

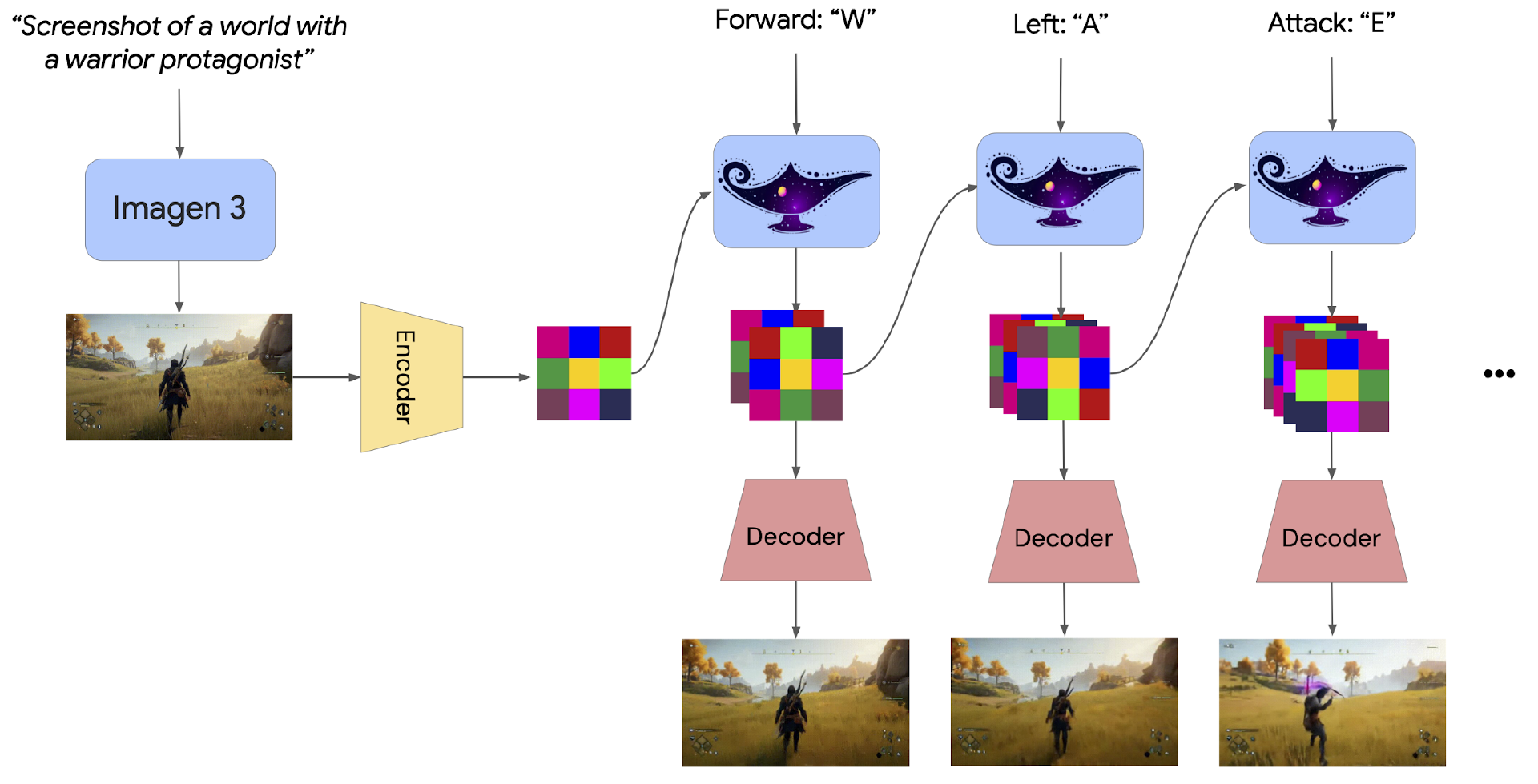

DeepMind 表示,训练更通用的具身智能体的统瓶颈在于缺乏足够丰富和多样化的训练环境。Genie 2 是在大规模视频数据集上进行训练的,模型使用Imagen 3 生成的单个图像进行提示。整个过程中,一个人或智能体提供键盘和鼠标操作,Genie 2 模拟下一个观察结果。Genie 2 可以生成长达一分钟的一致性世界,大多数示例持续 10-20 秒。

DeepMind 狂发演示,网友买账了?

话不多说,我们先看下官方给出的模型效果示例:

操作控件:智能地响应键盘上的按键操作,识别角色并正确移动,例如模型必须清楚箭头应该移动的是机器人而不是树木或云朵。

生成不同的“反事实体验”

下面的每个视频都从同一帧开始,但人类玩家采取的操作是完全不同的。“这意味着可以从同一初始帧生成不同的轨迹,这对于训练智能体非常有价值”

超长记忆:可以记住不再出现在视野中的部分世界,再次可见时能够准确地呈现它们。

持续生成新内容:动态生成新的合理内容,并在长达一分钟的时间内保持世界的一致性。

多样化环境:创建不同的视角,例如第一人称视角、等距视图或第三人视角驾驶视频。

创建复杂的 3D 结构

Genie 2 可以为不同类型的角色制作动画来执行不同的活动。值得注意的是,它可以模拟其他智能体,甚至与其进行复杂的交互。

Genie 2 还模拟各种物体的相互作用,例如爆破气球、开门和射击炸药桶。可以模拟各种物理效果,如水、烟雾、重力、灯光反射。此外,还通过现实世界的图像进行提示生成虚拟环境,比如风中摇曳的草或河中流动的水。

Genie 2 还能快速创建各种交互式体验原型,方便研究人员快速实验新的环境、训练和测试具体的 AI 智能体。得益于 Genie 2 的分布式泛化能力,概念艺术和绘图可以转化为完全交互式的环境。因此,艺术家和设计师也可以用它快速创建原型,加速环境设计过程。

通过使用 Genie 2 快速创建丰富多样的环境供 AI 智能体使用,研究人员还可以生成智能体在训练期间未曾见过的评估任务。下面是 DeepMind 与游戏开发者合作开发的 SIMA 智能体示例,首先 Imagen 3 生成图像:

提示词:A screenshot of a third-person open world exploration game. The player is an adventurer exploring a forest. There is a house with a red door on the left, and a house with a blue door on the right. The camera is placed directly behind the player. #photorealistic #immersive

SIMA 智能体旨在通过遵循自然语言指令来完成一系列 3D 游戏世界中的任务。Genie 2 生成一个有两扇门(一扇蓝门和一扇红门)的 3D 环境,并向 SIMA 智能体提供打开每扇门的指令。在此示例中,SIMA 通过键盘和鼠标输入控制化身,而 Genie 2 生成游戏帧。

提示:Open the blue door

另外,SIMA 可以帮助评估 Genie 2 的功能。研究人员通过指示 SIMA 环顾四周并探索房屋后面来测试 Genie 2 生成一致环境的能力。

提示:Go behind the house

当然也有网友对这个模型表达了 Genie 2 质疑:

这是一项很棒的技术,但人们可能会误以为它对游戏开发有用,但事实上它毫无用处。

游戏是关于互动的,而这一点恰恰与之背道而驰。你不希望模型推断机制,设计师需要深入控制它的每个方面。

人们提到过用它来制作游戏原型,但这完全没有意义。用它来制作原型到底意味着什么?它不会帮助你从机械或视觉上弄清楚任何事情。它只是“如果你是一个世界中的化身会怎么样?”当你在随机环境中使用随机角色控制器四处奔跑后,你会做什么?

我认为其中最有用的部分是世界生成部分,而不是机制推理部分。

另外,DeepMind 对 Genie 2 的技术细节描述过于简单,并不能满足开发者的好奇:Genie 2 是一个自回归的潜在扩散模型,在通过自编码器后,视频中的潜在帧被传递给一个大型的 transformer 动力学模型。Genie 2 可以逐帧地自回归采样,并使用无分类器引导来提高动作的可控性。

此外,DeepMind 表示还开发了一个可以实时运行的蒸馏版本的 Genie 2,但输出质量会有所降低。

智能体已经在游戏里交上朋友了

Genie 2 支持的与智能体互动实际上还是初级的。在开放世界游戏平台《我的世界》上进行的一个实验中,智能体已经可以开发工作岗位、共享文化模因(meme)、就税收改革进行投票,甚至传播宗教。

这项实验最多时有 1000 个软件智能体使用 LLM 进行交互。只需通过文本提示,这些智能体就能发展出一系列不同的个性特征、偏好和专业角色,而无需创造角色的人做进一步的输入。

这项工作由 AI 初创公司 Altera 完成。Altera 创始人 Robert Yang 辞去了麻省理工学院计算神经科学助理教授的职位,创办了这家公司。对他来说,这次演示仅仅是个开始。他认为,这是迈向大规模 “AI 文明”的第一步,“当我们真正拥有可以大规模协作的自主智能体时,AI 的真正力量才会被释放出来。”

受斯坦福大学研究员 Joon Sung Park 启发,Yang 在 2023 年发现,当 25 个自主 AI 智能体在一个基本的数字世界中自由互动时,会产生和人类类似的惊人行为。“他的论文一发表,我们下一周就着手开始研究了。六个月后,我就从麻省理工学院辞职了。”Yang 说道。

Yang 想把这个想法发挥到极致,“我们想突破 AI 智能体在群组中自主行动的极限"。

Altera 迅速从投资者那里筹集了超过 1100 万美元的资金,投资者包括 A16Z 和谷歌前首席执行官 Eric Schmidt 新创立的科技风投公司。今年早些时候,Altera 发布了他们的第一个演示:一个 AI 控制的角色在《我的世界》中与人类玩家并肩作战。

在 Altera 的新实验项目“Sid”中,模拟 AI 智能体配备了由多个模块组成的“大脑”。一些模块基于 LLM,设计用来完成特定的任务,例如响应其他智能体、说话或计划智能体的下一步行动。

开始时,他们在《我的世界》中测试了包含约 50 个智能体的群组,并观察它们之间的交互。在 12 个游戏日(现实世界的 4 个小时)里,智能体们开始做出一些有趣的突现行为,例如一些智能体变得非常善于交际,并与其他角色建立了许多联系,而另一些智能体则显得比较内向。

随着互动的继续,每个智能体的 “好感度 ”评级(由智能体自己测量)也在随时间变化。这些智能体能够跟踪社交线索并做出反应:在一个场景中,一个负责向饥饿者分发食物的 AI 厨师向它认为最重视它的人分发了更多的食物。

在一个涉及 30 个智能体的系列模拟中,出现了更多和人类类似的行为。

开始时,所有智能体的个性和总体目标都是一样的——创建一个高效的村庄,保护社区免受游戏中其他生物的攻击。它们在没有任何提示的情况下,自发地在社区中发展出了专门的角色,包括建筑工人、卫兵、商人和探险家。一旦智能体开始专业化,它在游戏中的行为就开始体现它的角色功能,例如艺术家会花更多的时间采花、农民会收集种子,卫兵则会建造更多的栅栏。

“我们惊奇地发现,如果放入正确的大脑,它们就能产生真正的突现行为。我们知道人类会有这样的行为,但并不曾想机器也会有。”Yang 说道。

Yang 的团队还测试了智能体能否遵守整个社区的规则。他们创建了一个具有基本税法的世界,并允许智能体投票改变游戏中的税收制度。按人类提示支持或反对征税的智能体能够影响周围其他智能体的行为,以至于它们会根据与谁互动来投票减少或增加税收。

随后,研究小组不断扩大规模。在不出现故障的情况下,他们将每个模拟中的智能体数量提高到《我的世界》服务器所能处理的上限,有时甚至能同时处理 1000 个智能体。

在 Altera 的一个涉及 500 个智能体的模拟中,他们观察了智能体们如何自发地提出并在同伴中传播文化模因(例如对恶作剧的喜爱或对生态问题的兴趣)。研究小组还让一小部分智能体在游戏世界的不同城镇和农村地区传播(模仿的)宗教——帕斯塔法里教,并观察这些帕斯塔法里教牧师如何让许多与他们互动的智能体皈依。这些皈依者会继续向游戏世界中附近的城镇传播帕斯塔法里教。

这些智能体的行为方式看起来非常逼真,但它们的行为只是将 LLM 从人类创建的数据中学习到的模式和 Altera 的系统相结合。该系统会将这些模式转化为情景感知动作,如拿起工具或与另一个智能体互动。Altera 公司联合创始人 Andrew Ahn 表示:“我们的收获是,LLM 拥有足够复杂的人类社会动力学模型,‘能够’反映这些人类行为。”

换句话说,这些数据使它们能够很好地模仿人类行为,但它们绝不是 “活的”。

但 Yang 有更宏伟的计划。Altera 下一步计划进军 Roblox(多人在线创作游戏),但 Yang 希望最终能超越游戏世界。他的最终目标是创造一个世界,人类不仅能与 AI 角色一起游戏,还能在日常生活中与它们互动。他的梦想是创造出大量的 “数字人类”,它们会真的关心我们,与我们一起工作,帮助我们解决问题,并让我们乐在其中。“我们希望创造出能够真正爱人类的智能体(就像小狗那样爱人类)。”

“AI 可能会爱上我们”的观点在这个领域中颇有争议。许多专家认为,利用现有技术不可能在机器中再现情感。

Julian Togelius 是游戏测试公司 Modl.ai 的人工智能资深专家,他表示自己喜欢 Altera 的工作,主要是因为它能让我们在模拟中研究人类行为。但是,这些模拟的智能体能学会关心我们、爱我们,或者变得有自我意识吗?Togelius 认为不会。“没有理由相信在某个地方的 GPU 上运行的神经网络会有任何经验。”他说道。

参考链接:

https://deepmind.google/discover/blog/genie-2-a-large-scale-foundation-world-model/