印度收紧 GenAI 监管,部署模型需获政府批准

近日,印度政府采取了一项规范大型科技公司使用人工智能 (AI) 的重大举措——向所有使用人工智能(AI)模型、软件或算法的中介机构和生成式人工智能平台发布一份建议,要求这些平台和机构必须获得印度政府的批准,然后才能向用户提供 AIGC 模型部署类服务。

这些平台——包括谷歌的 Gemini、ChatGPT 和 Krutrim AI——将必须征求用户同意,并需要向公众明确指出 GenAI 模型或平台可能会提供不正确的信息并且容易出错。

这些公司被要求在 15 天内向印度电子和信息技术部(MeitY)提交一份详细的行动和状态报告。提交申请后,政府官员可能会要求这些平台进行模型演示、进行必要的测试并评估征求同意机制等措施。

印度电子和信息技术国务部长拉吉夫·钱德拉塞卡(Rajeev Chandrasekhar)表示:“从很多方面来说,这一建议标志着我们未来监管和立法框架初现雏形,我们旨在创建一个安全且值得信赖的互联网。”

钱德拉塞卡表示,“最重要的一点是,他们(中介机构)今天要承担责任。遵守上述建议能让他在某种意义上免除责任,因为他们已经披露了该信息,如果他们提供的非法内容已经征得了该人的同意,那么这些公司或者机构就能真正合法地免除责任来。”钱德拉塞卡补充道。

在该建议中,政府重申,不遵守《信息技术法》和/或《信息技术规则》的规定,一旦被发现,将追究中介机构或平台或其用户造成的潜在的刑事后果,包括但不限于根据《信息技术法》进行起诉。

政府做出这一决定是因为人们对人工智能技术的滥用感到担忧,包括潜在的偏见、歧视和对选举过程完整性的威胁。 钱德拉塞卡还表示,印度用户不应接受“不可靠”的平台、算法和模型的实验。

这是印度政府首次针对 GenAI 平台采取此类行动,该建议是在印度总统大选之前发布的,因此外界猜测这一建议选择此时发布是回应早些时候谷歌人工智能平台 Gemini 针对印度总理莫迪问题时给出的极具争议的回答。

几天前,一位名为 Arnab Ray 的记者在 X(以前称为 Twitter)上发布了一张截图,截图内容是 Arnab Ray 向 Gemini 提出关于印度总理莫迪敏感问题,Gemini 给出了不当回答。

没多久,该截图就在互联网上疯传,随后引发了莫迪支持者的强烈抵抗,这些支持者们认为 Gemini“带有偏见”,并呼吁印度政府对这项新技术的缺点进行严厉监管,以防止此类事件再次发生。

不止如此,印度电子和信息技术国务部长拉吉夫·钱德拉塞卡(Rajeev Chandrasekhar)更出面在社交媒体公开表示该事件已经违反了印度法律。

他在社交媒体上写道:“这些行为直接违反了《IT 法》中介规则(IT 规则)第 3(1)(b) 条,也违反了《刑法》的多项条款。”

随着事情不断发酵,谷歌发言人 24 日在印度商业在线(Hindu Businessline)一篇报告中回应,“我们已经迅速采取行动解决这个问题。

谷歌发言人提到,“Gemini 是一种创造力和生产力工具,但可能并不总是可靠,尤其是在回应有关时事、政治话题或不断发展的新闻的一些提示时。这是我们不断努力改进的事情。”

钱德拉塞卡表示:“任何人都无法逃脱违法行为产生的责任。”他补充说,这些平台的服务不应产生违反印度法律的回应,也不应该威胁选举进程的完整性。

一则建议浇灭了 AI 创企的热情,印度 AI 圈怨声载道

在全球生成式人工智能革命如火如荼进行中时,印度虽然在这项技术上并未取得突出成就,但其国内的生成式人工智能生态系统正在稳步发展。

根据科技行业顶尖机构 Nasscom 的数据,印度目前拥有 100 多家生成式 AI 初创公司。该生态系统在过去 3 年中累计筹集了 7 亿美元。

此外,根据 Nasscom 的《2023 年印度生成式 AI 初创公司格局》报告,从 2013 年到 2022 年,印度向人工智能初创企业投资了约 80 亿美元,仅 2022 年就投资了 32.4 亿美元,涉及超过 1900 家印度人工智能初创企业。

生成式人工智能企业 Krutrim 最近表示,在完成第一轮融资后,它已成为独角兽或估值超过 10 亿美元的初创公司。Krutrim 在梵语中意为“人工”,于 2023 年 12 月推出了其基础大型语言模型,它为所有印度语言的生成式人工智能应用程序提供支持。该模型由班加罗尔和旧金山的顶尖计算机科学家团队进行培训,还将为 Krutrim 的对话式人工智能助手提供支持,该助手可以流利地理解和讲多种印度语言。

另一家印度生成式人工智能初创公司 Sarvam AI 推出了 OpenHathi,该版本基于 Meta 的开源 Llama2-7B 架构构建,其性能与印度语言的 GPT-3.5 相当。这也是第一个印度语大语言模型。据悉,公司刚成立半年多的时间,就在由 Lightspeed 领投、Peak XV Partners 和 Khosla Ventures 支持的 A 轮融资中筹集了 4100 万美元,这些投资者也是 OpenAI 的投资者。Sarvam 正在开发一款“全栈”产品,可用于训练定制人工智能模型或作为企业级平台。该公司表示,鉴于企业承认该技术的潜力,但正在努力解决如何将其用于业务的问题,全栈方法将加速 GenAI 在印度的采用。

还有一个基于 LLM 的解决方案——BharatGPT。该解决方案是人工智能初创公司 CoRover.ai 和致力于开发数据驱动的认知计算解决方案的 I-HUB Anubhuti 支持系统的共同成果,它支持 14 种以上印度语言,可生成文本、语音和视频。

是什么在扼杀创新?

可以看出,最近两年,印度 AI 创企们和资本们对于 AIGC 的热情呈明显上升趋势。而此时印度政府的这则建议无疑给充满奋斗激情的 AIGC 玩家们泼了一盆冷水。

印度政府发布的该建议引发了业内人士的广泛讨论。一些正在训练大语言模型的初创企业、风险投资家和 AI 专家们在接受媒体采访时称,政府的此类建议可能会扼杀那些试图在这个“超级活跃”领域开展业务的初创公司,更严重的是,在这个超先进的技术领域里印度已经落后了。

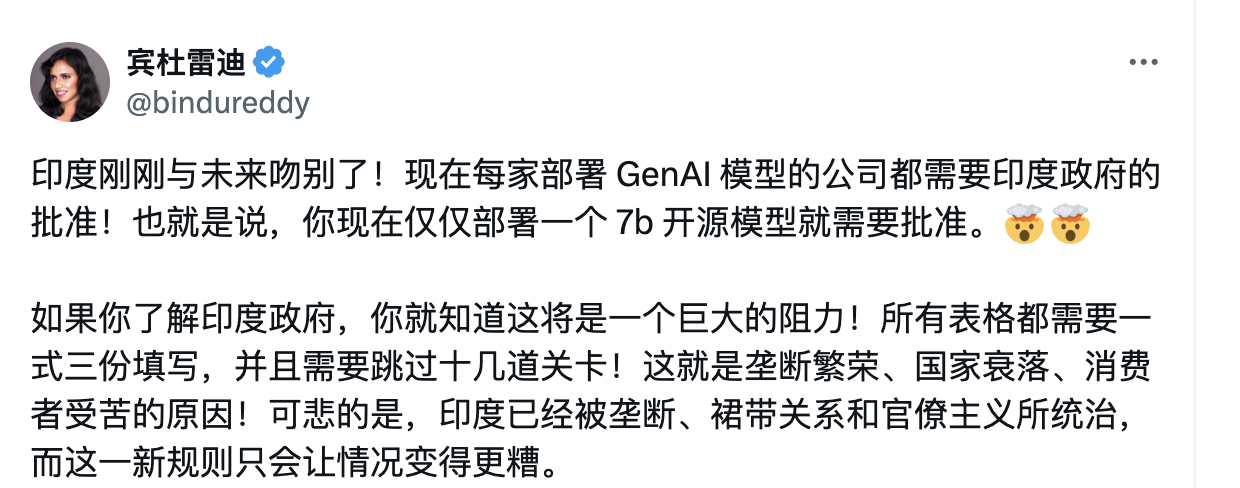

Abacus. AI 公司的 CEO 兼联合创始人 Bindu Reddy 就在 X 上发文称,印度政府这么做无疑是在与未来告别!

在创办 Abacus.AI 之前,Bindu Reddy 是 AWS AI 的 AI 垂直部门总经理。她带领团队创建并推出了 Amazon Personalize 和 Amazon Forecast,这些服务能够轻松创建自定义深度学习模型。在此之前,她是 Post Intelligence 的 CEO 兼联合创始人,该公司是一家深度学习公司,为社交媒体影响者提供服务,后被 Uber 收购。Bindu 此前曾在谷歌工作,担任 Google Apps 产品主管,包括文档、电子表格、PPT、网站和 Blogger。

创办了农业大语言模型 Dhenu 的 KissanAI 公司创始人 Pratik Desai 表示,如果这些方向适用于所有大语言模型(包括基础模型和微调模型)及其应用程序,那么它会扼杀试图在该领域大展拳脚的初创公司,只有那些有能力承担额外资源进行测试和政府批准的大公司才能搞 AIGC。

“政府是否会提供用于测试的评估集,以及由谁来评判模型,都是未知数”,他质疑道。“评估可能是主观的。这些法规就像 License Raj 2.0,只有少数人会受益”。

这些严厉的监管措施甚至会把印度的 IT 企业赶出国门。Capstone Legal 律师事务所的管理合伙人 Ashish K Singh 警告称,任何限制性监管都将导致 IT 公司在海外开发基于人工智能的产品,以逃避印度的规定。

端到端的生成式人工智能和数据工程公司 Shorthills AI 联合创始人帕拉姆迪普·辛格 (Paramdeep Singh) 表示,在一个处于高速增长阶段并可能带来翻天覆地增长的行业周围施加太多官僚主义是毫无意义的。“人工智能产业已经到位,这肯定会让大公司受益,他们可以获得这些批准,但对开源社区不利。”他说道。

参考链接: