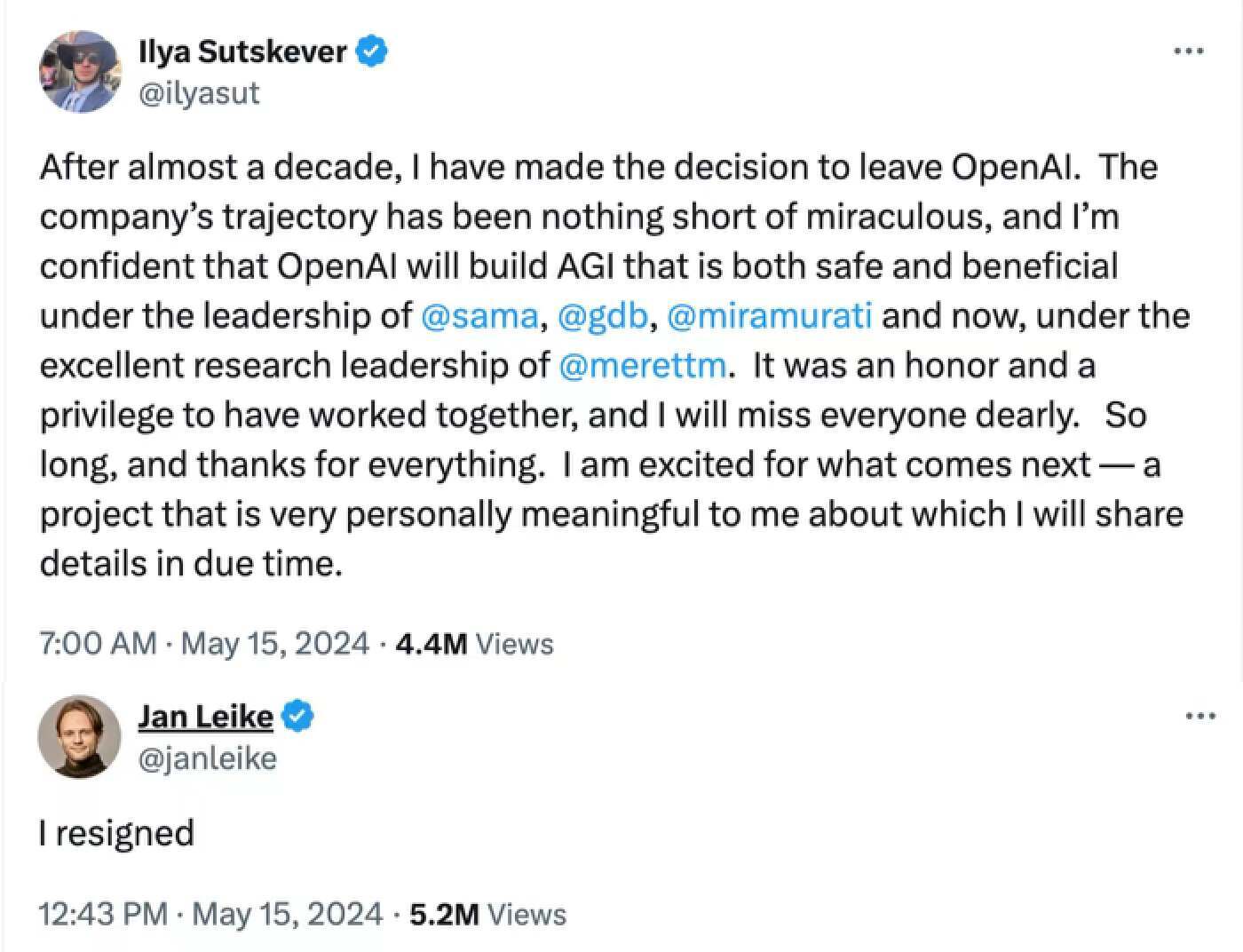

5 月 15 日,OpenAI 联合创始人 Ilya Sutskever 在社交平台上发文表示,决定离开 OpneAI。几个小时后,OpenAI 超级对齐团队的负责人 Jan Leike 也宣布离职,离职宣言没有像 Ilya 那样写小作文,他就写了一句话“我辞职了(I resigned)”。

值得注意的是,拥有 OpenAI 20% 计算资源的超级对齐团队(Superalignment Team)是由上面两个人领导的。

根据统计,自 OpenAI 董事会事件和 Altman 复职以来,离开 OpenAI 的具有安全意识的人名单包括:Ilya Sutskever、Jan Leike、Leopold Aschenbrenner、Pavel Izmailov、William Saunders、Daniel Kokotajlo 和 Cullen O'Keefe。

此外,近期离职的人还包括非营利组织和战略计划主管 Chris Clark 和社会影响主管 Sherry Lachman。

每个 OpenAI 离职员工宣布离职后,几乎都可以看到有人问:What did you see ? 当然这个问题并没有人回答。

“OpenAI 似乎确实没有多少使命了——他们的 CEO 散发着二手车推销员的气息,他最近提到考虑允许他们的人工智能生成色情内容,现在又发布了一个调情的 AI 女友作为他给人类的礼物。”有网友评价道。

“元老科学家”所剩无几

“Karpathy 和 Ilya 现在都已从 OpenAI 消失了。看起来,现在是 Sam Altman 和 Greg Brockman 的表演舞台了。不得不承认,在这四个人中,Karpathy 和 Ilya 是给我印象最深刻的两个。”

马斯克也曾这样称赞 Ilya:Ilya Sutskever 是 OpenAI 成功的关键。 Altman 也在宣布离职的帖子里说到,“没有他,OpenAI 就不会存在。”

去年 11 月,Ilya 与另外三名董事会成员一道,迫使该公司高调的首席执行官 Sam Altman 辞职,但后来他表示后悔。据报道,双方争论的焦点是对 OpenAI 方向的分歧:Ilya 对 Altman 以牺牲安全工作为代价而急于推出人工智能产品感到沮丧。

Altman 在被赶下台的五天后就回到了 OpenAI,重申了自己的控制权,并继续推动越来越强大的技术,这让他的一些批评者感到担忧。Ilya 仍然是 OpenAI 的员工,但他再也没有回去工作。

围绕 Ilya 工作的模糊性引发了一个迷因:Ilya 在哪里?他看到了什么? OpenAI 联合创始人马斯克经常在他拥有的平台 X(以前的 Twitter)上亲自提出这个问题。

能看到的动态是,Ilya 在去年帮助 OpenAI 创建了超级对齐团队,任务是建立防护措施,以防止人工通用智能(AGI)失控。和其他人一样,他越来越担心人工智能可能变得危险,甚至可能毁灭人类。

但是,Ilya 和 Leike 领导的这个超级对齐团队人员非常不稳定。

今年 2 月,William Saunders 离开了 OpenAI。自 2021 年以来,Saunders 一直在安全团队工作,该团队后来成为超级对齐团队。Saunders 还是可解释性团队的经理,该团队研究如何使 AGI 安全,并检查模型如何以及为什么会这样表现。他与人合作撰写了几篇关于人工智能模型的论文。

也是在这个月,备受尊敬的研究科学家 Andrej Karpathy 也宣布离开 OpenAI。他表示,自己的离开并不是因为任何事件、问题或戏剧性事件,而是他要去追求自己的项目。

Karpathy 是 OpenAI 的创始成员,最初于 2017 年离开公司加入特斯拉。2022 年,他离开特斯拉,并在大约一年前重新加入 OpenAI。Karpathy 在社交媒体和 YouTube 上拥有大量粉丝,发布了有关新兴领域发人深省的文章以及解释人工智能内部运作原理的视频。

3 月,对齐研究员 Ryan Lowe 离开,参与过 GPT-4 对抗性测试的 Daniel Kokotajlo 也离开了 OpenAI。Kokotajlo 在他的网上论坛 LessWrong 个人主页上写道,他退出是因为“对 AGI 时代的行为失去信心”。

他还曾参与关于暂停 AGI 开发的讨论。Kokotajlo 写道:“大多数要求暂停的人都是在试图反对‘选择性暂停’,以及要求对处于进步前沿的大型实验室的实际暂停。”

他认为,目前的奥弗顿之窗(overton window )似乎围绕评估风险和采取缓解措施的组合,这具有很高的监管俘获风险(即导致选择性暂停,而这并不适用于最需要暂停的大公司!)“我的幻灭感是我离开 OpenAI 的原因之一。”

4 月,据知情人士透露,OpenAI 解雇了两名涉嫌泄露信息的研究人员,其中包括超级对齐团队的 Leopold Aschenbrenner,Aschenbrenner 是 llya 的盟友。另一位从事推理研究的研究员 Pavel Izmailov 也曾在安全团队工作过。目前,Pavel Izmailov 已经跳槽到马斯克旗下的 xAI,明年也将成为纽约大学助理教授。

最近,多名涉嫌透露消息给外界的“内鬼”也被 OpenAI 开除。

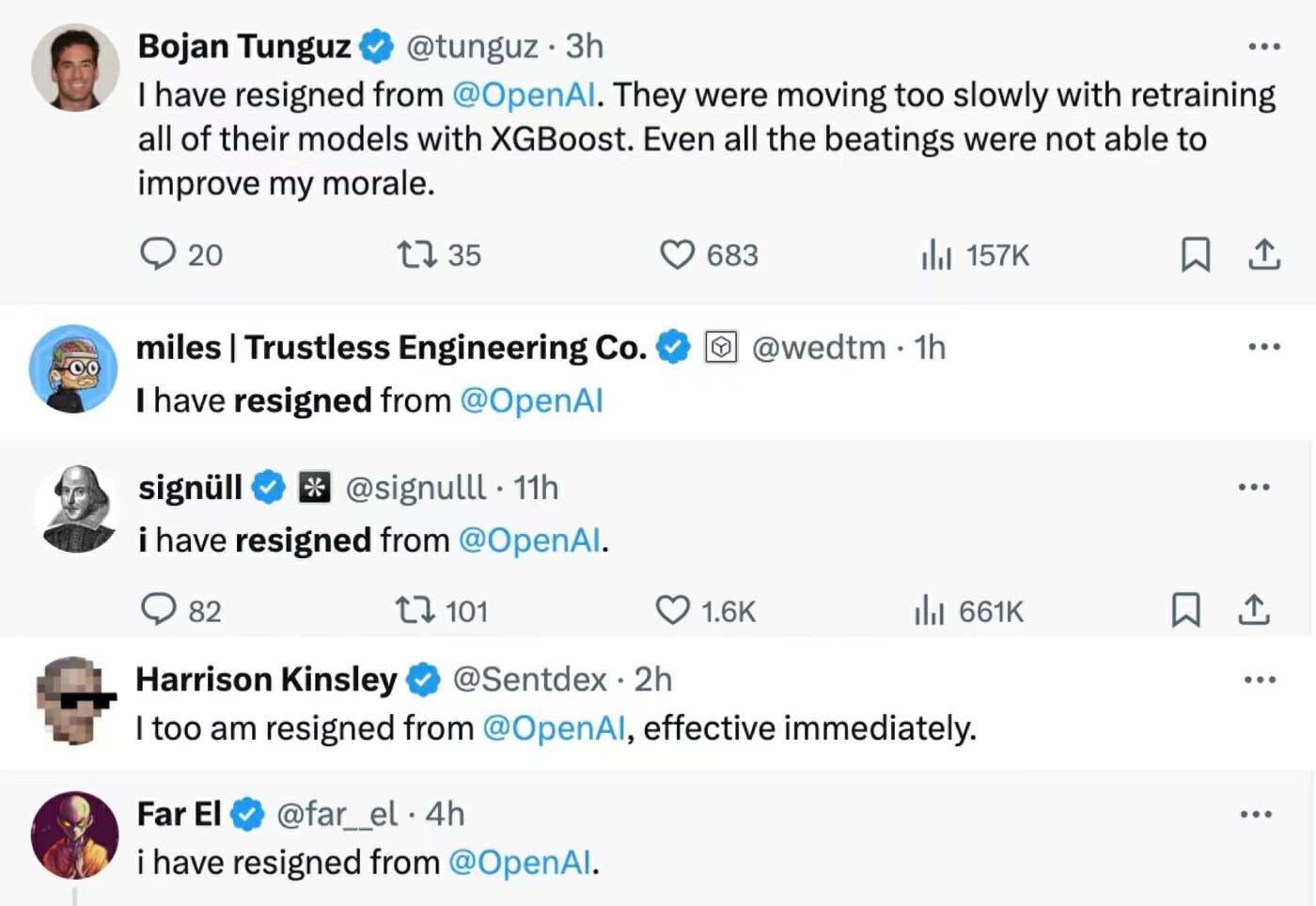

“OpenAI 正在失去最优秀、最注重安全的人才。”这是大家对此的评价。鉴于最近从 OpenAI 离职的人数之多,不少网友都开始调侃:“我从 OpenAI 离职了”。

OpenAI 被营销支配?

“六位顶尖科学家早已离去。OpenAI 如今由营销、业务、软件和产品化人员运营。”

从左到右:Jakub Pachocki、Greg Brockman、Ilya Sutskeve、Sam Altman、Muri Murati

上图中,除去 Ilya,几乎就是当前 OpenAI 的重要管理层了。

OpenAI 的关键研究员 Jakub Pachocki 将接替 Ilya 担任该公司的首席科学家。在 Altman 被罢黜前几周,曾帮助监督 GPT-4 创建的 Pachocki 被提升到公司研究总监的位置,一度被提升到与 Ilya 并肩的职位。

Pachocki 于 2017 年加入 OpenAI Dota 团队,担任研究主管,该团队构建了一个能够在 Valve 的 Dota 2 策略游戏中击败人类玩家的人工智能系统。随后,Pachocki 成为 OpenAI 深度学习组织推理和科学的研究负责人,然后晋升为研究总监。目前尚不清楚 Pachocki 是否也会接任 OpenAI Superalignment 团队的负责人。

而 Jan Leike 离职后,他的职位将由该公司另一位联合创始人 John Schulman 担任。Schulman 在去年失败的董事会政变中站在了 Altman 一边。另外,Schulman 在 Superalignment 团队还担任了监督者角色。

当然,OpenAI 也在不断引进新的人才,年轻力量正在支撑 OpenAI。比如 GPT-4o 的多模态负责人 Prafulla Dhariwal,实际只有本科学历;Sora 的论文作者中有一位研究员今年刚满 21 岁,仅有高中毕业证。

但众所周知,OpenAI 更多使用的是谷歌提出的技术路线,其核心研发实力不如他们的工程能力。元老科学家们的出走还是让大家对 OpenAI 的未来产生了担忧:OpenAI 还能实现 AGI 吗?

AI 行业人才短缺是不争的事实,AI 相关的部门很难找到合适的员工。AI 人才争夺战已经开始,甚至有企业都给出了 100 万美元年薪。

薪酬数据和职业平台 Levels.fyi 联合创始人 Zuhayeer Musa 在采访中表示,OpenAI 提供的中位工资(包括奖金和股权)为 925,000 美元。Meta 的 344 名机器学习和人工智能工程师,包括奖金和股权在内的薪酬中位数约为 40 万美元。

除了巨额薪酬之外,从小型初创公司到 OpenAI、Meta 等,都在提供加速的股票兑现计划,甚至试图挖走整个团队。

“他们没有护城河。那些从事科学研究的人现在正在为其他公司做研究,并且会让 OpenAI 感到震惊。”有网友对 OpenAI 的人才出走评价道。

“OpenAI 对 Microsoft 的需要几乎就像 Microsoft 对 OpenAI 的需要一样”。有网友认为,“当下一波新的深度学习创新浪潮席卷全球时,微软会吃掉 OpenAI 剩下的东西。他们赚了很多钱,但除非他们弥补失去的东西,否则就没有未来。”

OpenAI 与微软的紧密联系让一些人希望,至少出于对品牌保护,微软能够在安全研究上做一定的投入。但具有讽刺意味的是,微软在发布“人工智能”产品之前不进行安全检查方面是已经出名了的。

还有很多人认为,OpenAI 全力以赴地让大模型这只“金鹅”产生更多收益、专注于如何通过嵌入广告实现货币化,并通过主题限制继续提供“安全”等,而不是进一步沿着 AGI 路线前进。

“LLM 通往 AGI 或超级智能的机会为零。因此,如果这就是 OpenAI 在未来 5 年里要关注的全部内容,那么与 Superalignment 相关的小组就没有必要了。”有网友评价道。

有人推测,要么离 AGI 太远,以至于无论“对齐”意味着什么都是不必要的,要么就是奥特曼等人已确定这是商业成功的障碍。

“事实证明,我们已经结盟了,这就是所谓的资本主义。”也有人说道,“资本主义本身就是一种不结盟的人工智能,从这个角度来理解就可以澄清很多事情。”

结束语

“近十年后,我决定离开 OpenAI。这家公司的发展轨迹堪称奇迹,我相信 OpenAI 将打造出既安全又有益的人工智能。”38 岁的 llya 补充说,他正在启动一个新项目,但没有详细说明。

Karpathy 和 Ilya 都有了自己的项目,显然,人们希望那些伟大的人工智能科学家还能在一起做一些有意义的事情。不过,我们应该很快能看到他们多年从事 AI 研发的总结成果。

参考链接: