本文最初发表在 Skynet Today 网站,经原作者 Eric Hofesmann 授权,InfoQ 中文站翻译并分享

Deepfake 是什么,如何使用,以及它对大众的影响有多大?

引言

利用图像和视频来操纵媒体已经有数十年的历史。

举例来说,在第二次世界大战期间,Mousollini 公布了一张自己骑在马背上的宣传照片,并将他的驯马师剪掉。这样做的目的是要使自己显得更令人印象深刻,更有力量。鉴于受众的数量,这类伎俩可能会产生重大影响,特别是在互联网时代。

DARPA 已经构建了一套完整的媒体取证方案,用于检测被操纵的媒体。

与 Deepfake 的影响力相比,有朝一日,假新闻可能显得苍白无力。

Deepfake 是一种计算机视觉方法,它能创造出极其逼真的篡改图像或视频。近几年来,它们的质量和受欢迎程度都呈井喷之势。Deepfake 一词来自于由“深度”学习算法生成的“假”图像或视频。你很可能看过一段电影场景中演员换脸的视频,其准确度之高,令人震惊。

由于制作逼真的换脸视频比好莱坞的传统特效技术成本更低,且更容易获得,这项技术有可能为恶意行为者提供传播前所未有的虚假信息的手段。

这一点令人担忧,因为假新闻已经非常普遍,人们经常在没有任何证据的情况下就去相信新闻。就在最近,Twitter上有一段经过编辑的视频获得了 100 万的观看次数,这段视频的内容是拜登似乎不知道自己身在哪一个州。

如果有人想利用虚假信息进一步加深自己的认知失调,Deepfake 可以为他们提供“证据”。这是一个真正的威胁,美国国会已经通过了两个法案H.R.3230、S.3805,旨在打击以非法目的传播 Deepfake。

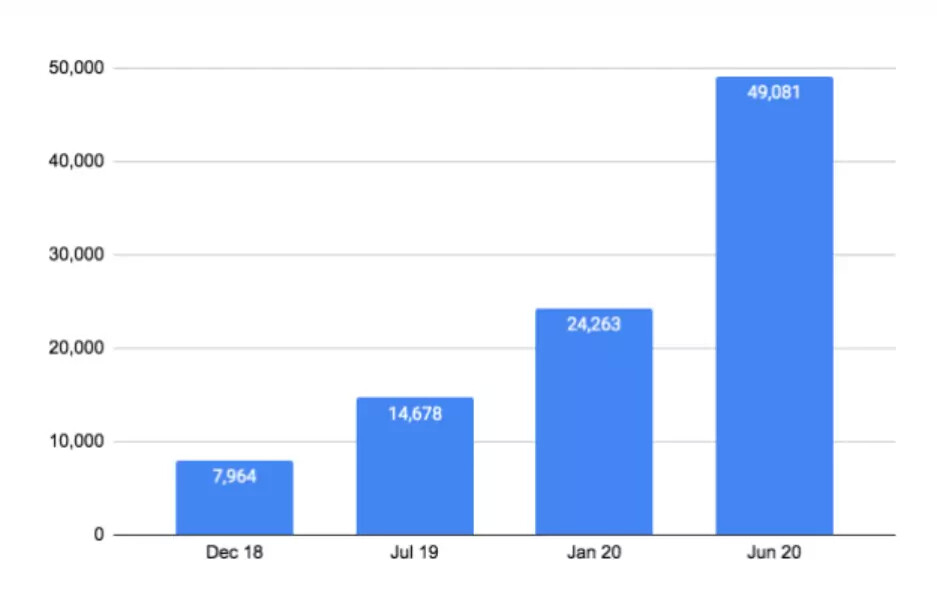

截止 2020 年 7 月检测到的 Deepfake 数量。

Deepfake 指的是一种特定的合成媒体,即把图像或视频中的人与另一个人的脸部互换。

合成图像和视频生成一直是一个不断发展的计算机视觉子领域,随着 2014 年生成对抗网络(Generative adversarial networks,GAN)的引入,它们得到了很大的发展。

“Deepfake”一词最早是由一位 Reddit 用户在 2017 年创造出来的,他使用该技术利用换脸技术制作名人的假色情作品。从那时起,该术语已经发展到涵盖更广泛的图像和视频增强和生成以及一些音频应用。

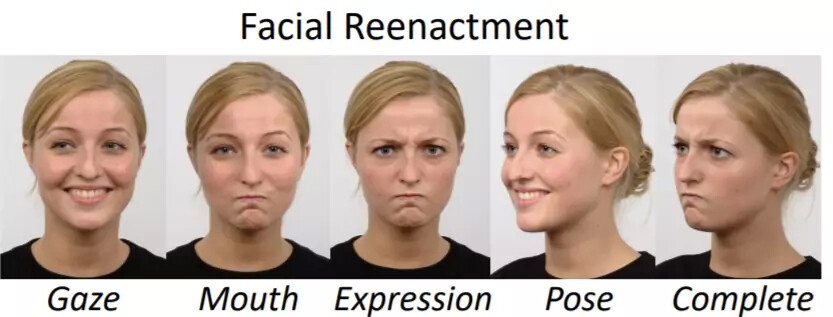

Mirsky 和 Lee指出,Deepfake 有多种形式。下面是一些不同类型的女性脸部的 Deepfake 的示例:

再扮演

再扮演(Reenactment),是指利用你的面部或身体动作来控制另一个人的动作。

目前的再扮演(reenactment)的工作都在寻找最小化的训练数据量,以便能够生成一个修改后的人脸。小样本学习和少样本学习已经成为流行的方法,以利用来自己许多不同面孔的数据,但只需在其目标面孔的少量选定样本上进行微调即可。这里的一些主要方法是MarioNette和FLNet。

替换

替换(Replacement),就是你的身份映射到另一个人(例如,Snapchat 的换脸滤镜)。

为了在保留相同表情时,将源面孔映射到目标面孔,许多替换作品都会应用编码器 - 解码器网络或变自编码器来。在替换中遇到的常见挑战是,在物体经过目标面孔时,需要处理遮挡。最近的替换模型包括FaceShifter和FaceSwap-GAN。

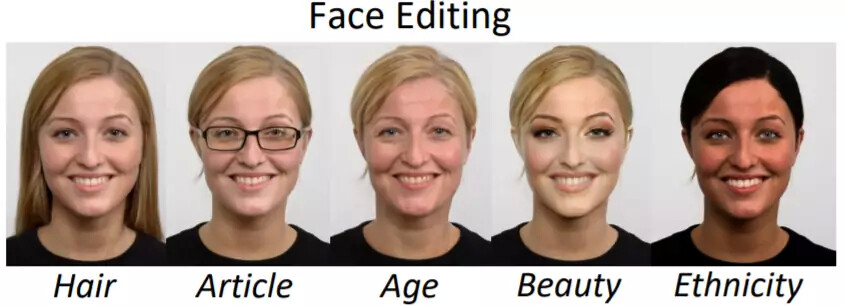

编辑

编辑(Editing),指的是以某种方式改变一个人的属性(比如改变他们的年龄或眼镜)。

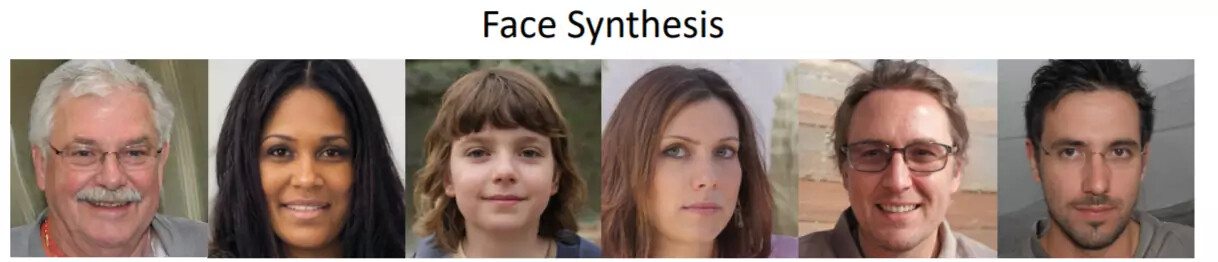

合成

合成(Synthesis),指的是在没有目标人物的情况下,生成全新的图片或视频。

再扮演和替换是 Deepfake 最突出的两种类型,因为它们的破坏性应用潜力最大。例如,政客的脸可以被再扮演,以说出他们从未说过的话;或者一个人的脸可以被替换成一个有罪的视频,以达到勒索的目的。

这些类型的被操纵的媒体(无论是否 Deepfake)都可能是有罪的,或者破坏目标的声誉,就像前面提到的拜登的推文一样,上面写着美国州名的标志被编辑成他不知道自己在哪里的样子。

对于 Deepfake,人们最关心的是,让再扮演和替换变得简单而廉价:你不必了解所涉及的技术细节,就能创造出 Deepfake。像 DeepFaceLab 这样的工具,让任何人都可以拿一张图片或视频来替换一张脸,让一张脸更年轻,或者操纵一段语音。

对于真正无缝的 Deepfake,这样的工具可以提供高质量的脸部生成,但你仍然需要一些视频编辑软件的经验(如 Adobe After Effects),将它们添加到视频中。如果你没有意愿或能力自己制作,你甚至可以找到一些服务和市场来帮你制作 Deepfake。一个例子是 https://Deepfakesweb.com/,你只需要上传你想要的视频和图片,就会在云端为你创建一个 Deepfake。

Deepfake 是如何被利用的

截止 2019 年,共检测到 14678 个视频。

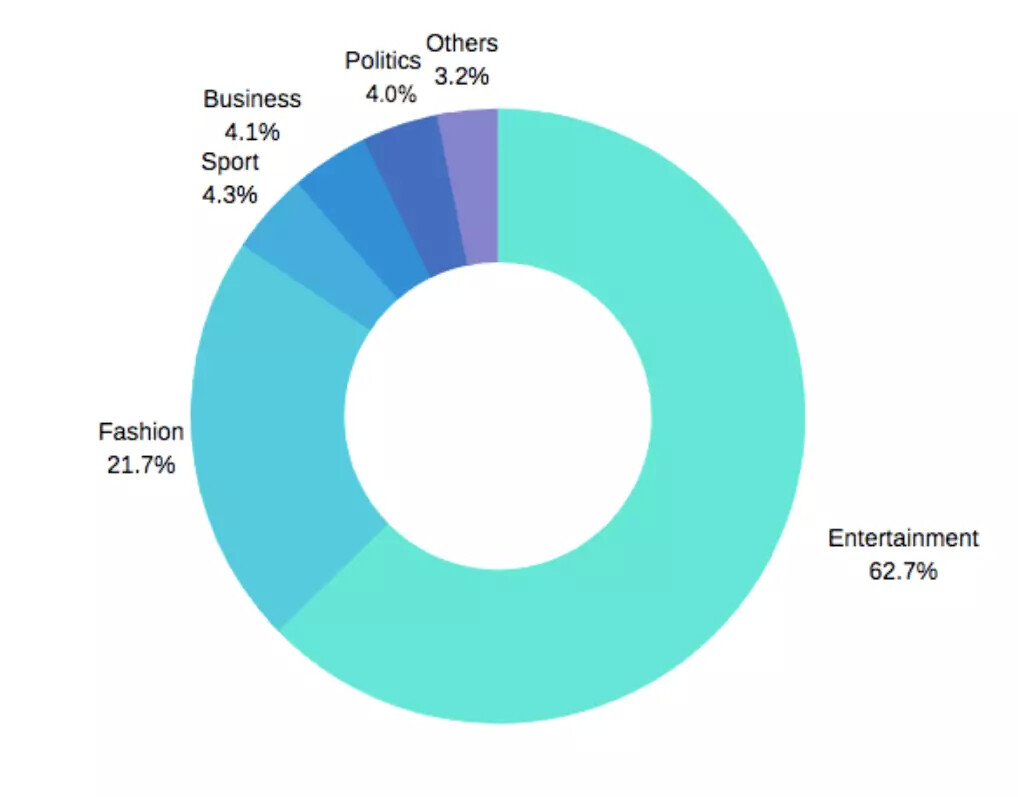

当 Deepfake 在 2017 年首次流行起来时,它们绝大多数被用于在互联网论坛上生成名人的假色情作品。即使在 2019 年,根据公司Sensity所做的调查,96% 的公开发布的 Deepfake 都是色情内容。Deepfake 的目标(把脸换成 Deepfake 的人)一般都是那些从事娱乐业的人。

截止 2020 年 6 月,从总共 49081 个检测到的视频中的 Deepfake 目标分布情况。

媒体中的 Deepfake

除了色情作品外,各种各样的网络创作者还将 Deepfake 应用于其他形式的媒体,比如电影片段;个人不断制作病毒式传播的视频,并与其他演员交换影星的面孔。例如,在 YouTube 最近的一段视频中,施瓦辛格和史泰龙的面孔出现在电影《非亲兄弟》中。

施瓦辛格和史泰龙出现在电影《非亲兄弟》的 Deepfake。

虽然这类视频表明 Deepfake 在娱乐行业可能是有用的,但这些病毒式的视频大多只是简短的演示,还没有好莱坞的大制作利用 Deepfake。

虽然,有些人可能会说,好莱坞应该已经在使用 Deepfake 了。人们对 Netflix 在电影《爱尔兰人》(The Irishman)中所用到的人脸年轻化效果的质量颇有微词。对此,有人在电影中应用了人脸年轻化的 Deepfake,并得到了令人印象深刻的效果,也许好莱坞制作直接使用这些工具只是时间问题。

尽管还没有大制作使用过 Deepfake,但是已经有一些小制作尝试了 Deepfake。最值得注意的是,一位制作人在他的关于车臣男女同性恋者受迫害的纪录片中使用了 Deepfake,以此来掩盖被采访者的身份。

正如上面的例子所展示的那样,除了可能的负面用途之外,当涉及到娱乐行业时,它们还可以带来新的可能性。例如,能够选择你想看的电影中的哪个演员,这可能会真的很酷。而且,像《周六夜现场》(Saturday Night Live)那样的喜剧模仿,无疑也会随着 Deepfake 达到一个全新的高度。

事实上,就在前几周,《南方公园》(South Park)的创作者 Trey Parker 和 Matt Stone 在 YouTube 上开辟了一个新的喜剧系列,名为“Sassy Justice”,其核心就是利用 Deepfake 进行名人模仿。如果你是《南方公园》的粉丝,你一定要去看看。

视频链接:https://youtu.be/dCTM2lvm0QE

政治中的 Deepfake

无论何时,只要一个 Deepfake 视频在网上引起关注,就会有许多人发表评论说,他们担心利用 Deepfake 来影响政治以达到邪恶目的。这些担忧绝对是有道理的,因为在信息时代,你可以在互联网上散布关于你的政敌的虚假新闻,而这些虚假新闻可以蒙骗观众,这将是灾难性的。

到目前为止,已经有不少针对政治的 Deepfake,其中很多是讽刺性的。其中最受欢迎的是 Jordan Peele 制作的,他再扮演了奥巴马的面孔。他这样做并非出于恶意,而是为了让人们意识到,Deepfake 对于塑造政治格局的潜力。

视频链接:https://youtu.be/cQ54GDm1eL0

利用 Deepfake 来发表政治声明的另一个例子是这些视频,金正恩和普京讨论选举和权力和平过渡必要性。

视频链接:https://youtu.be/ERQlaJ_czHU

视频链接:https://youtu.be/sbFHhpYU15w

到目前为止,只有少数几起利用非讽刺性的 Deepfake 来影响政治的案例被公开。但是,仅仅因为 Deepfake 是为了影响政治而制造的,并不一定意味着它就是恶意的。例如,积极的 Deepfake 可以被用来让政客接触到更广泛的受众。一位印度政客 Manoj Tiwari 对他发布的一份声明进行了 Deepfake,将其翻译成其他语言,比如英语。

英文版。视频链接:https://youtu.be/88GUbuL89bQ

原文版。视频链接:https://youtu.be/2Tar2O4q0qY

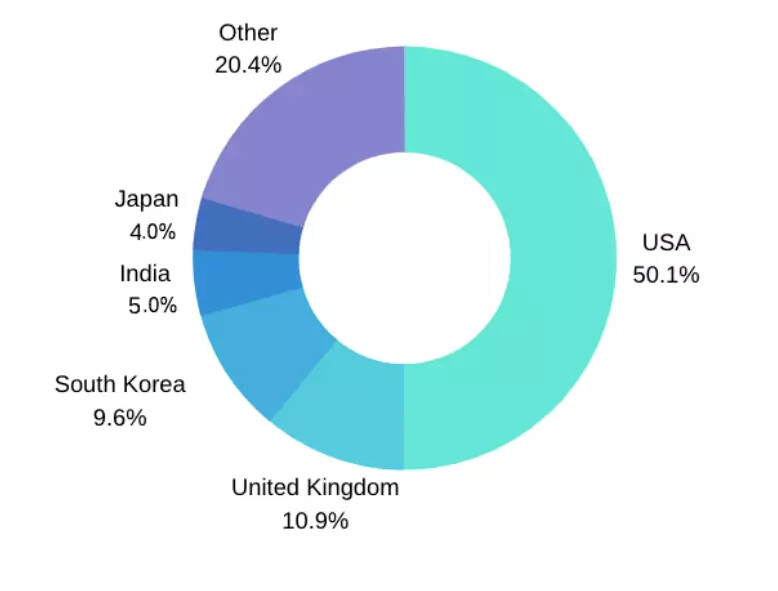

除了这款 Tiwari 的 Deepfake 之外,被检测出的大部分 Deepfake 都是针对印度的。不过,绝大多数被发现的 Deepfake 都是针对美国和英国的。由于 Deepfake 已经遍及全球,Deepfake 的影响范围可能远不止美国政治。

按目标国家 / 地区分布的已检测出的 Deepfake 的分布情况。

尽管还没有因为 Deepfake 而引发战争,但是已经有一些关于 Deepfake 被用来攻击政治对手和思想的例子。比利时的一个政治团体编造了特朗普关于巴黎气候协议的一段假新闻,以说服人们在请愿书上签字,呼吁政府采取更多行动来应对气候变化。

特朗普的 Deepfake

尽管这个 Deepfake 的质量很差,而且通过看他的口型就能让人们很容易地认出是 Deepfake,但众多评论者还是被欺骗了,纷纷为视频中的言论大声谴责特朗普。

随着 DeepFake 的质量越来越高,人们不仅担心你可能无法判断视频是否是伪造的,而且也有人可能会声称一段真正的有罪视频实际上是伪造的。

去年,一位马来西亚政客因为一段他从事同性恋活动(同性恋在马来西亚是非法的)的视频而锒铛入狱,而这名政客声称这段视频是假的。专家们无法具体确定这段视频是否是伪造的。将来,这种声称真实视频是假视频的辩解可能会被用于更严重的罪行。

我应该担心吗?

截至目前,尚未发生针对 2020 年美国大选的明显的 Deepfake 事件,总的来说,假新闻和假消息仍然是一个更大的问题。也就是说,通过人工编辑制作的视频,比如显示拜登在接受电视采访时睡着了的视频 ,比目前深度学习模型输出的内容更值得关注。除此之外,最大的虚假信息来源是来自谣言和论坛,而非任何一个视频 。

然而,许多人仍然预测,Deepfake 必然会让这些虚假信息变得更糟糕。幸运的是,随着 Deepfake 技术的进步,有越来越多的方法可以检测 Deepfake。Kaggle 上已经举办了多场竞赛,旨在创造更好的 Deepfake 检测器 。此外,还收集了一些数据集来帮助训练这些检测器 。

这种 Deepfake 检测器的工作原理是通过训练在图像和视频中寻找一系列不同的 Deepfake 标识。例如,Face X-ray是一种设计用来寻找边界的方法,当一张 Deepfake 的面孔被融合回目标图像或视频中时。

另一种方法是观察图像的背景,并将其与人脸进行比较,看两者之间是否存在差异。情感识别网络也被用来检测脸部显示的情绪是否与场景的背景和音频相匹配,以确定演员的行为是否表明是 Deepfake。另一种可以利用人类生物学来检测 Deepfake,甚至识别所使用的 Deepfake 模型的方法是检测视频目标的心跳,并分析该信号的残差。这些 Deepfake 检测作品大多有开源代码可供使用,但是也有一些商业化的 API,例如sensity、deepware和Microsoft Video Authenticator。

在文献中,这些检测器是根据它们在常见的 Deepfake 数据集上检测真实或伪造视频的准确性进行比较的。一些最好的模型在这些数据集上能够达到 99% 以上的准确率。这说明这些数据集已经得到了解决,但还需要做更多的研究,利用最先进的 Deepfake 技术生成新的数据集。

因为在实验室之外的 Deepfake 上,这些方法很少显示结果,所以我决定选择一个 Kaggle 比赛的获胜者,在这篇文章中显示的一些 Deepfake 上进行尝试。

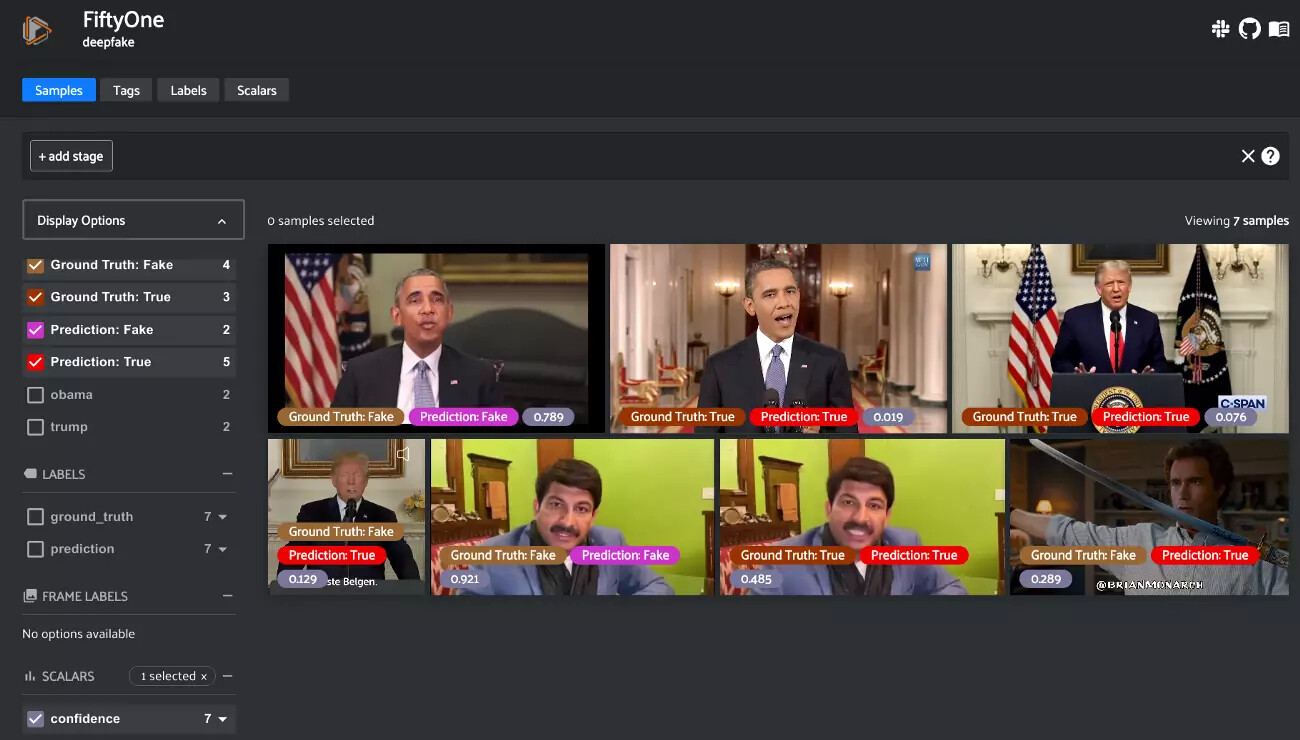

以上是我们的机器学习可视化工具FiftyOne中显示的Deepfake 检测器结果。在这里下载这个示例。

这个Deepfake 检测模型无法识别出《非亲兄弟》和特朗普的视频是假的。即使对于人类观察者来说,《非亲兄弟》的 Deepfake 例子也是相当完美的,但特朗普的视频,如果你注意到他的口型不对劲,那么这段视频显然是假的。

因此,即使这些模型在常见的 Deepfake 检测数据集上表现良好,但在现实世界的场景中使用它们并不像人们所预期的那样一致。如果你有兴趣自己进行这样的摸索,你可以查看Jupyter Notebook 上记录的过程和结果。

这说明,在 Deepfake 变得更加普遍之前,有必要继续对 Deepfake 检测器进行研究。幸好,高质量的 Deepfake 仍然需要人工干预来润色输出,这样就会减缓其传播速度,并给 Deepfake 检测模型改进的时间。

发现 Deepfake

能够防止 Deepfake 被恶意利用的最好方法就是训练人们识别 Deepfake 的明显迹象,以免他们不小心上当。虽然有些 Deepfake 做得很好,但很多时候还是有一些共同的特征会让人看出来的。

根据麻省理工学院研究员Matt Groh的说法,如果你认为你可能看到的是一个 Deepfake,那么你应该特别仔细地观察它。

脸部:脸部的某些部位是否出现了“毛刺”?当他们说话时,他们的眉毛和面部肌肉是否会动?他们的头发看起来是否自然地垂下?

音频:音频和人脸上的表情是否匹配?音频中有没有怪异的剪辑或跳跃,听起来不自然?

光线:视频中是否有部分光线与场景其他部分不匹配?你在眼镜之类的东西上看到反光了吗?

通过查看 detectfakes.media.mit.edu,你可以了解你在识别 Deepfake 方面的能力。该网站提供了 Deepfake Detection Kaggle 挑战赛中的示例,以测试您是否可以像 Deepfake 检测模型一样识别 Deepfake。

总结

在未来的媒体中,Deepfake 可能会产生可怕的错误信息。然而,目前的技术状况仍处于初级阶段,高质量的 Deepfake 需要大量的人工操作。

随着 Deepfake 的改进,应对 Deepfake 的方法和算法也在不断完善。至少在目前,更令人担忧的是通过人工编辑的图片和视频来传播错误信息。

作者介绍:

Eric Hofesmann,在密歇根大学获得计算机科学硕士学位,专攻计算机视觉。在计算机视觉初创公司 Voxel51 工作时,曾帮助开发了 FiftyOne 工具,以便研究人员可以快速加载并开始查看数据集和模型结果。

原文链接:

https://www.skynettoday.com/overviews/state-of-deepfakes-2020