互联网是人类知识的浩瀚海洋,但它不是无限的。而人工智能(AI)研究人员几乎要把它吸干了。

过去十年,人工智能爆炸性的发展在很大程度上是由于神经网络规模的扩大以及对越来越多数据的训练。事实证明,这种规模化(scaling)在制作大语言模型(LLM)(如那些为聊天机器人 ChatGPT 提供动力的 LLM)方面非常有效,既能更好地复制会话语言,又能开发诸如推理之类的突现特性。但一些专家表示,我们现在正在接近规模化的极限。这在一定程度上是因为计算的能源需求不断膨胀,但这也是因为 LLM 开发人员正在耗尽用于训练模型的传统数据集。

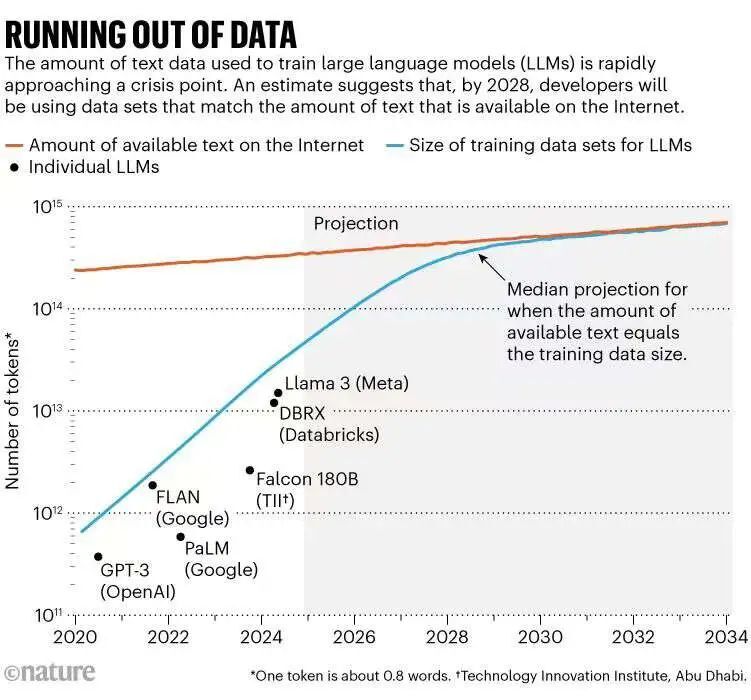

今年,一项著名的研究 因对这个问题进行了量化而成为头条新闻:虚拟研究机构 Epoch AI 的研究人员预测,到 2028 年左右,用于训练人工智能模型的数据集的典型规模将达到与公共在线文本总估计量相同的规模。换句话说,人工智能很可能会在 大约四年内耗尽训练数据(参见“数据耗尽”)。与此同时,数据所有者(如报纸出版商)也开始严厉打击其内容的使用方式,进一步收紧了访问权限。麻省理工学院的人工智能研究员 Shayne Longpre 表示,这导致了“数据共享”规模的危机,他领导着数据来源倡议,这是一个对人工智能数据集进行审计的草根组织。

训练数据即将出现的瓶颈可能已开始显现。Longpre 说:“我强烈怀疑这种情况已经发生了。”

尽管专家表示,这些限制可能会减缓人工智能系统的快速发展,但开发人员正在寻找解决方案。“我认为在大型人工智能公司中没有人会感到恐慌。”

Epoch AI 驻马德里研究员、预测 2028 年数据耗尽的研究报告的主要作者 Pablo Villalobos 说到。“或者至少他们不会给我发电子邮件。”

例如,位于加利福尼亚州旧金山的 OpenAI 和 Anthropic 等知名人工智能公司已经公开承认了这个问题,同时表示他们有计划解决这个问题,包括生成新数据和寻找非常规数据源。OpenAI 的一位发言人告诉《自然》杂志:“我们使用了多种来源,包括公开可用的数据和合作伙伴的非公开数据、合成数据生成以及来自人工智能训练师的数据。”

即便如此,数据危机可能会迫使人们构建的生成式人工智能模型发生剧变,可能会将格局从大型、通用的 LLM 转变为更小、更专业的模型。

数万亿个词

过去十年,LLM 的发展显示出了对数据的极大需求。尽管一些开发人员没有公布他们最新模型的规格,但据 Villalobos 估计,自 2020 年以来,用于训练 LLM 的“token”或单词部分的数量增加了 100 倍,从数千亿增涨到了数万亿。

这可能是互联网上内容的很大一部分,尽管总量如此之大,以至于很难确定——据 Villalobos 估计,目前互联网上的文本数据总量为 3100 万亿个 tokens。各种服务使用网络爬虫抓取这些内容,然后消除重复并过滤掉不需要的内容(如色情内容),以生成更干净的数据集:一个名为 RedPajama 的常见数据集包含数十万亿个词。一些公司或学者自己进行抓取和清理,以制作定制的数据集来训练 LLM。互联网中只有一小部分内容被认为是高质量的,比如书籍或新闻中可能出现的人工编辑、社会可接受的文本。

可用的互联网内容的增长速度慢得惊人:据 Villalobos 的论文估计,其年增长率不到 10%,而人工智能训练数据集的规模每年翻一番多。预测的这些趋势表明,这些线将在 2028 年左右趋于一致。

与此同时,内容提供商越来越多地在内容中加入软件代码或完善其使用条款,以阻止网络爬虫或人工智能公司抓取其数据进行训练。Longpre 和他的同事们今年 7 月发布了一份预印本,显示阻止特定爬虫访问其网站的数据的提供商数量急剧增加。在三个主要的清理数据集中,质量最高、使用最频繁的网络内容中,限制爬虫访问的令牌数量从 2023 年的不到 3% 上升到 2024 年的 20-33%。

目前正在进行几起诉讼,试图为用于人工智能训练的数据提供者赢得赔偿。2023 年 12 月,《纽约时报》起诉 OpenAI 及其合作伙伴微软侵犯版权;今年 4 月,纽约 Alden Global Capital 旗下的八家报纸联合提起了类似的诉讼。相反的观点是,应该允许人工智能以与人相同的方式阅读和学习在线内容,这构成了对材料的合理使用。OpenAI 曾公开表示,它认为《纽约时报》的诉讼“没有法律依据”。

如果法院坚持内容提供商应该获得经济补偿的观点,这将使人工智能开发人员和研究人员更难获得他们所需要的东西,包括那些没有雄厚财力的学者。Longpre 说道:“这些交易对学术界的打击最大。”他补充道:“开放的网络有很多非常有利于社会、有利于民主的好处。”

寻找数据

数据危机给传统人工智能的规模化策略带来了一个潜在的大问题。Longpre 表示,尽管可以在不扩大训练数据的情况下扩大模型的计算能力或参数数量,但这往往会导致人工智能缓慢而昂贵,这通常不是首选。

如果目标是找到更多的数据,一种选择可能是收集非公开数据,比如 WhatsApp 的消息或 YouTube 视频的转录文字。尽管以这种方式抓取第三方内容的合法性尚未得到检验,但公司确实可以访问自己的数据,而且几家社交媒体公司也表示,他们使用自己的材料来训练他们自己的人工智能模型。例如,位于加利福尼亚州门洛帕克的 Meta 表示,其虚拟现实耳机 Meta Quest 收集的音频和图像用于训练其人工智能。然而,政策各不相同。视频会议平台 Zoom 的服务条款规定,该公司不会使用客户内容来训练人工智能系统,而转录服务 OtterAI 表示,它确实使用去标识和加密的音频和转录文字进行训练。

然而,据 Villalobos 估计,就目前而言,此类专有内容可能总共只持有另外千万亿个文本的令牌。考虑到其中很多是低质量或重复的内容,他说,这足以将数据瓶颈推迟一年半,即使假设单个人工智能可以访问所有数据而不会造成版权侵犯或隐私问题。他说:“即使数据量增加十倍,也只能为你带来大约三年的规模化时间。”。

另一种选择可能是专注于正在快速增长的天文或基因组数据等专业数据集。加州斯坦福大学著名人工智能研究员李飞飞公开支持这一策略。她在 5 月份的彭博科技峰会上表示,鉴于医疗保健、环境和教育等领域尚未开发的信息,对数据耗尽的担忧使人们对数据构成的看法过于狭隘了。

但 Villalobos 表示,目前还不清楚这些数据集对于训练 LLM 有多大的可用性或实用性。“似乎在多种类型的数据之间都存在一定程度的迁移学习。”Villalobos 说道。“也就是说,我对这种方法并不抱太大希望。”

如果生成式人工智能是在文本以外的其他数据类型上进行训练的,那么可能性就更大了。一些模型已经能够在一定程度上对未标记的视频或图像进行训练。扩展和改进这些能力可能会为更丰富的数据打开闸门。

Meta 首席人工智能科学家、纽约大学计算机科学家 Yann LeCun 被认为是现代人工智能的创始人之一,今年 2 月,他在加拿大温哥华举行的人工智能会议上发表了演讲,强调了这些可能性。用于训练现代 LLM 的 10 的 13 次方个 token 令牌听起来很多:LeCun 计算出,一个人需要 17 万年才能读完这么多。但是,他说,一个 4 岁的孩子在醒着的时候仅仅通过看物体就吸收了比这大 50 倍的数据量。LeCun 在人工智能促进协会的年会上展示了这些数据。

类似的数据丰富性最终可能会被机器人形式的人工智能系统所利用,这些系统可以从自己的感官体验中学习。LeCun 说:“仅仅通过语言训练,我们永远无法达到人类水平的人工智能,这根本不可能发生。”。

如果找不到数据,可以多创造一些。一些人工智能公司付费让人为人工智能训练生成内容;另一些公司则使用人工智能生成的合成数据来训练人工智能。这是一个潜在的巨大来源:今年早些时候,OpenAI 表示,它每天生成 1000 亿个词,即每年超过 36 万亿个词,大约与当前的人工智能训练数据集大小相同。而且这一产出还在迅速增长。

总体而言,专家们一致认为,合成数据似乎适用于有严格、可识别规则的领域,如国际象棋、数学或计算机编码。人工智能工具 AlphaGeometry 通过 1 亿个人工合成的示例,在没有人工演示的情况下,成功地训练出解决几何问题的能力。合成数据已经被用于真实数据有限或有问题的领域。这包括医疗数据,因为合成数据没有隐私问题,以及自动驾驶汽车的训练场,因为合成汽车碰撞不会伤害任何人。

合成数据的问题在于,递归循环可能会巩固虚假信息,放大误解,并普遍降低学习质量。2023 年的一项研究创造了“模型自噬障碍”(Model Autophagy Disorder)这个词,用来描述人工智能模型如何以这种方式“发疯”。例如,部分基于合成数据训练的人脸生成 AI 模型开始绘制嵌入奇怪哈希标记的人脸。

少即是多

另一种策略是放弃“越大越好”的概念。尽管开发人员继续构建更大的模型并倾向于规模化以改进他们的 LLM,但许多人正在追求更高效、更专注于单个任务的小模型。这些需要精确、专业的数据和更好的训练技术。

总的来说,人工智能已经在用更少的资源做更多的事情。2024 年的一项研究得出结论,由于算法的改进,LLM 实现相同性能所需的计算能力每八个月左右就会减半。

这一点,再加上专门用于人工智能和其他硬件改进的计算机芯片,为以不同的方式使用计算资源打开了大门:一种策略是让人工智能模型多次重复读取其训练数据集。斯坦福大学博士生、数据来源倡议组织成员 Niklas Muennighoff 表示,尽管许多人认为计算机具有完美的记忆力,只需要“阅读”一次材料,但人工智能系统是以统计方式工作的,这意味着重读可以提高性能。在 2023 年他在纽约的人工智能公司 HuggingFace 发表的一篇论文中,他和他的同事们表明,一个模型从四次重复读取给定的数据集中学到的东西与从读取相同数量的单独数据集中学到的一样多——尽管重读的好处在那之后很快就消失了。

尽管 OpenAI 尚未披露其最新 LLM o1 的模型规模或训练数据集的大小,但该公司强调,该模型倾向于一种新方法:将更多时间花在强化学习上(模型获得最佳答案的反馈过程),并花费更多的时间来思考每个响应。观察人士表示,该模型将重点从使用大量数据集进行预训练上转移,更多地依赖于训练和推理。Longpre 说表示,这为规模化方法增加了一个新的维度,尽管这是一种计算成本很高的策略。

LLM 可能已经阅读了互联网上的大部分内容,不再需要更多的数据来使自己变得更聪明。宾夕法尼亚州匹兹堡卡内基梅隆大学研究人工智能安全的研究生 Andy Zou 表示,人工智能的自我反思可能很快就会带来进步。“现在它有了一个基础知识库,这可能比任何一个人的都要大,”Zou 说,这意味着它只需要坐下来思考。“我认为我们可能已经非常接近这个目标了。”

Villalobos 认为,所有这些因素——从合成数据到专门的数据集,再到重读和自我反思——都会有所帮助。“模型能够独立思考,并且能够以各种方式与现实世界互动,这可能会推动前沿的发展。”

原文链接: