本文是 InfoQ“解读 2020”年终技术盘点系列文章之一。

2020 年,新冠疫情肆虐全球,严重扰乱了原有的生活秩序,给各个行业带来严重的打击。在这一年里,人工智能相关技术和产业也迎来了全新的问题和挑战。

笔者将从计算机视觉在学术界的发展和工业界的应用两个角度出发,对这一年来涌现出的新技术和新方法进行回顾和总结,并展望明年的发展趋势。

计算机视觉技术在学术界的发展

过去的几年里,科研人员主要着眼于计算机视觉技术在图像分类、目标检测以及语意分割等任务中的研究和应用。

随着算法精度的不断提升,自从今年开始,科研人员逐渐将注意力转向自监督学习、数据跨域分析以及轻量化模型设计等更加基础的研究工作中。

1.1 基于 Transformer 的目标检测

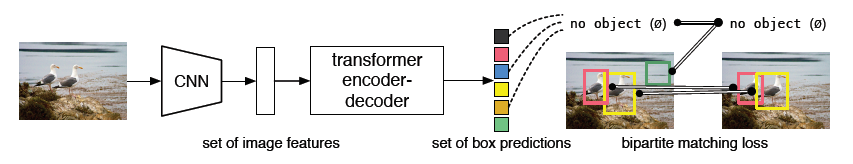

Facebook 提出的 DETR(DEtection TRansformer)是今年备受关注的一项代表性工作。该工作摒弃了现有的经典目标检测算法如 SSD、YOLO、Faster-RCNN 中广泛使用的 Anchor、NMS 等处理过程,借鉴自然语言处理领域广泛使用的 Transformer 结构来进行目标检测任务,实现了真正意义上的“端到端目标检测”,也该领域提供了一种全新的解决方案。

完整的 DETR 模型共包含两个部分,分别是由卷积神经网络(CNN)构成的特征提取模块,和基于 Transformer 的 Encoder-Decoder 模块,具体算法框架如图 1 所示。在目标检测任务中,DETR 按照集合预测的方式直接对目标进行检测和识别,既保证了预测结果与实际标注的一一对应,又不需要设置密集的 Anchor。

从检测精度来看,DETR 优于 Faster-RCNN 等常用算法,但是该方法对于小目标的检测能力较差。此外,基于 Transformer 的 DETR 模型具有较强的泛化性,预训练模型经过简单的调整,即可应用于实例分割等任务。基于 Transformer 的 DETR 模型虽然思路新颖,但也存在收敛速度慢、精度不足等缺点。

在 DETR 的基础之上,科研人员又提出了多种基于 Transformer 的目标检测算法,如 Deformable-DETR、UP-DETR 等,从不同角度来解决原始 DETR 模型的缺点,并取得了较好的结果。在计算机视觉领域中,Transformer 不仅仅只被用于目标检测任务中,在图像分类、人体姿态估计、文字识别等问题上也被广泛应用,并取得了良好的效果。

图 1 DETR 算法框架

1.2 自监督学习

自监督学习是当下计算机视觉领域一项热点研究课题。

自监督学习是指模型可以从大量无标签数据中自动的学习所需的知识。在人工智能领域中,模型需要对大量精确标注的数据进行建模和分析,从中学习用于解决某些问题的特定规律。在情绪识别、医学图像处理、3D 关键点检测等实际任务中,很难获取大量精确标注的数据,因此如何使用大量无标签数据,并设计恰当的算法,来指导模型自动学习成为了一项备受关注的问题。

以面部运动单元(Action Unit)识别问题为例,为了提升该任务的识别精度,中科院计算所提出了一种基于自监督学习的特征解耦算法(TACE),该方法从数据角度出发,指导模型从大量的无标注人脸视频数据中解耦出用于描述面部运动单元的 AU-Feature 和用于表示头部姿态的 Pose-Feature,然后通过图像重建的方式,将不同图像之间的特征进行迁移。

TCAE 有效的解决了面部运动单元识别问题中训练数据匮乏、标注精度不足等问题,明显提升了面部运动单元算法的识别精度。

在 TCAE 的基础上,科研人员又提出了一种基于注意力机制的自监督学习算法,在 BP4D、GIF 等多个数据集上,测试精度优于现有的有监督学习方法。

在表情迁移领域,自监督学习算法也同样大放异彩。被公众熟知的 DeepFake 方法需要对特定的数据进行单独调优,因此并不是一个通用的表情迁移方法。

为了设计一种通用的人脸表情迁移模型,Samsung 研究院提出了一种基于自监督学习的图像生成方法,该工作设计了两个编码器(Encoder)分别用来提取人脸图像的 ID 特征和姿态特征,然后使用解码器(Decoder)来重建人脸。该方使用大量未标注的人脸视频数据进行训练和优化,并取得了优异的结果。

1.3 轻量化目标检测算法

目标检测算法是计算机视觉中的一项基础任务,在安防、无人驾驶等多种实际问题中均被广泛应用。

在学术界,科员人员一方面探索高精度的检测模型,另一方面也在设计轻量化的通用目标检测器。

随着人工智能产业落地的进程逐步加快,轻量化目标检测模型备受关注。今年 Yolo 系列算法也从 V3 逐步更新到 V5。Yolo-V5 模型通过优化特征提取网络、Anchor 数量、超参配置方式、图像增广方法,既提升了检测精度,有加快了推理速度。目前该方法已经被工业界大量使用。

计算机视觉技术在工业界的应用

2020 年新冠疫情的爆发,为人工智能相关产业的落地和应用带来了更多的挑战和机遇。

下面将对计算机视觉技术在工业界应用进行介绍。

2.1 口罩人脸识别

佩戴口罩是当前阻隔病毒传播最好的方式之一,因此成为我们日常生活中的必需品。佩戴口罩会遮挡大量的面部区域,从而导致现有的人脸识别系统失效。在公共区域摘下口罩完成人脸识别有可能面临交叉感染的风险,因此设计并研发出稳定的口罩人脸识别算法成为今年的一项重点工作。

各大公司分别从视觉注意力机制、特征恢复重建以及细粒度特征识别等不同角度提出了相应的解决方案,为阻止疫情蔓延和增长贡献了一份力量。

图 2 口罩人脸识别

2.2 无接触式测温

无接触式测温,通常被我们称为 AI 测温,是疫情爆发初期最早被投入市场的人工智能产品之一。

该技术通过人体识别、人像检测、红外传感器测温等多种计算机视觉和传感器融合等多种创新技术,来实现无接触式测温方案。

这种方法可以快速的鉴别出密集人流中的体温异常人员,并与现有的人脸识别、目标追踪等 AI 技术配合,准确的定位到个体,减小公共场所工作的人员的压力,提升群众出行便捷度和安全性。

图 3 无接触测温设备

2.3 无人配送

在科幻电影中经常出现的无人配送随着科技的进步和发展逐渐成为了现实。

美国科技巨头 Amazon 的无人机配送服务以于 2013 年底进行测试,并逐渐开始商业化运营。国内的无人配送服务虽然起步稍晚,但最近几年飞速发展,京东、阿里等科技公司也相继展开了无人配送服务。今年疫情期间,为了防止病毒传播和扩散,国内各大科技公司更是大力增加相关技术的研发力度。

目前,无人配送设备大多使用计算机视觉技术作为核心解决方案,其中主要涉及到目标检测、图像分割、文字检测与识别等多项技术。无人配送服务的大量普及也是计算机视觉技术落地和应用的一种具体表现。

疫情期间,京东科技的智能物流机器人帮助武汉市第九医院运送医疗物质和生活用品;苏宁集团的 5G 配送机器人辅助门店提供无接触式配送服务;美团的无人配送车辆更是出现在北京市的多个社区中,为社区居民提供外卖和生鲜配送服务。大量无接触式配送服务的出现,既缓解了疫情传播的风险,又为人们的生活提供了便利。

图 4 无人配送外卖车

2.4 视频传输压缩技术

随着疫情在全球蔓延,大量公司逐渐转向居家办公,工作人员之间的交流和沟通主要依赖于网络会议软件,如腾讯会议、zoom 等。

但随着远程办公人数的增加,视频会议软件承载的流量呈现出指数型增长的态势,网络延迟、丢包、视频卡顿等是有发生,严重影响与会者的使用体验。

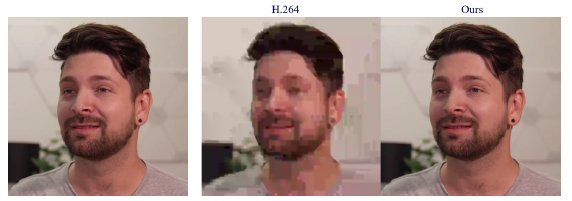

针对这一问题,Nvidia 公司提出了一种基于小样本学习的视频压缩技术。该方法通过提取输入视频的头部运动姿态、ID 特征以及光流信息,然后通过人脸关键点来辅助人脸图像重建。

实验结果显示,与现有的网络视频传输方法相比,该方法仅使用原来 10%的带宽,即可达到同等的画面清晰度。

图 5 画质清晰度对比

展望

计算机视觉技术在这一年里蓬勃发展,涌现出了一系列优秀的论文和项目,助力疫情防控和社会复工复产。在今后的一段时间内,笔者认为计算机视觉技术在学术上会沿着无监督学习、自监督学习等方向快速发展;同时计算机视觉与自然语言处理之间的界限会逐渐模糊,甚至有可能出现一种统一的解决方案。

在产业化方面,基于计算机视觉技术的应用会逐渐渗透到我们的日常生活中;此外,无人驾驶、无人配送等技术也将加速落地。

作者介绍 :

沙宇洋,中科院计算所工程师,北京邮电大学硕士,目前主要从事人脸识别以及无人驾驶等相关方向的研究和实际产品开发。